全球首个“力位混合控制算法”,机器人操作成功率提升接近近40%

近日,北京通用人工智能研究院具身智能机器人团队在机器人算法领域取得重大突破,提出全球首个“力位混合控制算法的统一理论”。该算法无需依赖力传感器,就能让机器人同时学习位置与力的控制,相关任务成功率较只使用位置控制的策略提高了约39.5%。更值得关注的是,其相关论文目前已斩获国际机器人学习大会杰出论文奖,这也是该奖项设立以来,首次由全中国籍学者团队摘得。

传统方法在处理涉及力的控制任务时,往往依赖昂贵、笨重或不可用的力传感器,而力位混合控制算法可让机器人在无需力传感器的条件下,同时学习位置与力的控制,降低了机器人的成本和复杂性。而利用机器人的历史状态信息(如姿态、角速度、关节角度等)和动作数据,可以反向估算出机器人受到的合外力,进而通过调整位置和速度来补偿这些力,从而实现无需力传感器即可同时进行力控制和位置控制。

机器人能在感受到外力时,及时对这一外力做出相应反应,在人机协作任务中,当与人类共同搬箱子、推车等时,能与人类保持动作同步,根据人的不同运动状态进行实时调整,提升了人机交互过程中的人员安全性和协作协调性。

UniFP的创新算法是足式机器人第一个能够在单一框架下统一处理力与位置的控制算法。核心灵感来自阻抗控制,巧妙地把机器人末端执行器与环境之间的交互视作一个弹簧-阻尼-质量系统。这一算法就好比给机器人装上了一个“虚拟触觉”,让它能够感知并主动对环境施加力,回应环境。

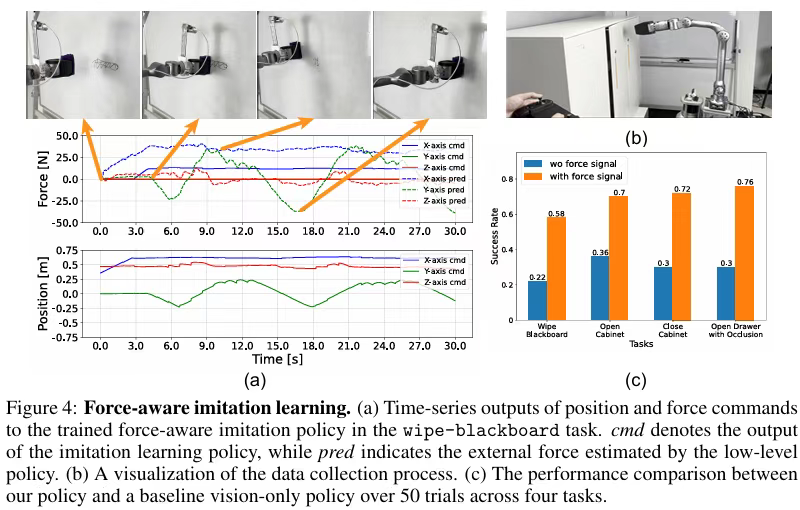

在北京通用人工智能研究院的实验现场,一个搭载了这项新算法的四足机械犬,正有条不紊地执行擦白板的训练任务。科研人员借着这一实操场景,解释了力位混合控制算法的核心原理与突出优势。

科研人员介绍,当前广泛应用的视觉-语言-动作模型(VLA),在应对现实生活中的诸多任务时,往往会显得“力不从心”,核心问题就在于这些任务大多涉及复杂的接触场景。比如,擦黑板时,机械臂必须既贴合表面又保持适当的压力;开关柜门时,需精准感知内部的推拉弹簧结构。机器人需要的不仅是“走到哪里”“手伸到哪里”,还需要理解“该用多大的力”。而在没有力位混合控制算法前,这些都需要通过力传感器来解决。

在研究中,团队在四个需要力位混合控制和力感知的真实世界任务上评估UniFP,任务包括擦黑板、打开柜门、关闭柜门和打开存在遮挡的抽屉。UniFP比基线高约40%的成功率。在擦黑板任务中,纯位置策略无法保持稳定的接触,导致擦不干净或用力过猛而导致的表面损坏。相比之下,UniFP的力感知策略确保持续的接触压力,同时底层策略提高了柔性并减少了机械应力。

为验证UniFP的跨机器人平台能力,在Unitree G1人形机器人和Unitree B2-Z1四足移动操作平台上进行了测试。对于移动任务,与操作任务不同,根据公式调整机器人机身速度以补偿外力。当补偿后的速度与速度指令大小相等方向相反时,人形机器人会停止并倾斜身体以保持平衡。

随着力位混合控制算法的深度应用,机器人不仅可以在没有力传感器的条件下,实现位置跟踪、施力、力跟踪以及柔顺交互等多种操作行为,大幅提升了任务成功率,更在人机协同安全性上取得了重要突破,为未来机器人应用场景的拓展奠定了基础。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。