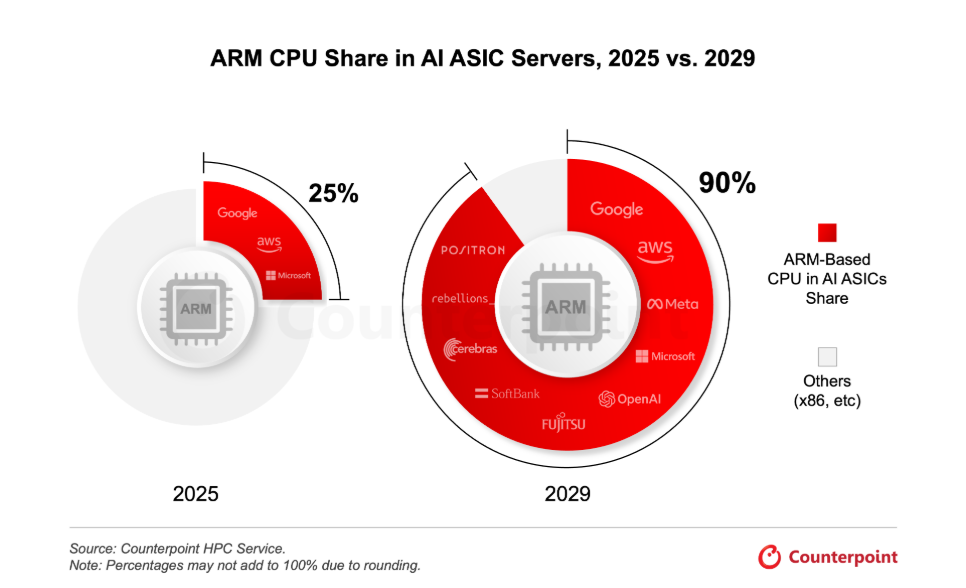

2029年AI ASIC服务器CPU:Arm架构占九成

根据 Counterpoint Research HPC 服务发布的最新数据中心 AI 服务器计算 ASIC 出货量预测和跟踪报告,定制 AI 服务器基础设施的主机 CPU 层正在经历一场悄然但结构性的变革,x86 架构正逐渐被专有的基于 Arm 的设计所取代 。

虽然公众对人工智能基础设施的讨论几乎完全集中在加速器的出货量上,但研究机构自下而上地跟踪谷歌、AWS、微软、Meta 和其他主要超大规模数据中心运营商的主机CPU 连接率,揭示了一种独立且未被充分重视的需求转变正在并行发生。

过去三年,基于 x86 架构的 CPU 在 AI 基础设施加速器部署中占据了主导地位。领先的超大规模数据中心运营商在当前一代ASIC服务器部署中一直依赖英特尔和 AMD 的处理器作为主机 CPU,这反映了软件兼容性要求和现有数据中心基础设施的现状。然而,在这个不断增长的市场中,由于半定制 AI 加速器或 XPU 对异构架构的需求,可以看到基于 Arm Neoverse 内核的 Arm 服务器 CPU 的采用率正在大幅提升。

对于超大规模数据中心而言,此举本质上是出于成本和效率方面的考虑。通过自主设计主机处理器和人工智能加速器,超大规模数据中心旨在实现多元化,降低对商用芯片供应商的依赖,在规模化运营中重新获得利润,并降低运维成本。因此,专有的Arm CPU最初面向通用云工作负载,之后才被设计用于人工智能服务器程序。基于Arm架构的CPU的每瓦性能最高可达同类x86机架式配置的两倍,这对于希望在固定功耗范围内最大化计算密度的超大规模数据中心而言至关重要。

研究助理David Wu强调了这一趋势:“虽然x86架构目前在人工智能服务器基础设施中仍占据重要地位,但经过逐代分析表明,这一既有优势正在迅速向基于Arm的专有设计过渡。预计,这一转变将在2026年下半年加速。了解哪些超大规模数据中心运营商以及哪一代ASIC芯片正在从x86过渡到Arm,才是获取有效洞察的关键所在。”

人工智能超大规模数据中心中基于 Arm 架构的 CPU 的普及

对于谷歌而言,其下一代 TPU 基础设施中基于 Arm 的 Axion CPU 的快速部署是这一转型过程中最重要的单一事件,这表明基于 Arm 的 CPU 现在已经准备好进行大规模 AI 基础设施部署。

AWS也一直在逐步改变其 Trainium 架构,基于 Arm 的 Graviton 处理器在高密度配置中发挥着越来越重要的作用,即使 x86 架构在某些部署中仍然保留以保持向后兼容性。

除了谷歌和AWS之外,Arm架构的转型正在超大规模云服务领域迅速发展。微软从一开始就将其Azure Cobalt ARM CPU与Maia AI加速器系列相结合。

进入 Arm AGI CPU

Meta 最近确认 Arm 为其下一代 MTIA 基础设施的战略 CPU 合作伙伴,并且 Meta 被指定为Arm 首款AGI CPU的启动客户,这进一步表明,摆脱商用 x86 架构是一个深思熟虑的、全行业的趋势,而不是一个孤立的设计决策。

研究副总裁尼尔·沙阿表示:“人工智能服务器从x86架构向Arm架构的过渡并非一蹴而就,而是逐步推进,逐代迭代,逐配置调整。超大规模数据中心运营商正根据自身特定的部署需求做出审慎的选择,编写兼容且可互操作的软件,经济效益也十分可观。预计在2026年下半年,随着各大超大规模数据中心运营商广泛部署自主研发的Arm CPU以及下一代ASIC平台,这一过渡进程将显著加速。”

Shah补充道:“我们的分析预测,到2029年,基于Arm的CPU将占定制AI ASIC服务器主机CPU部署的至少90% ,高于2025年的约25%,这一结构性转变是由主要超大规模数据中心加速推出内部Arm CPU项目所驱动的。”

这一转变也对更广泛的半导体供应链产生了重大影响。随着超大规模数据中心转向采用先进工艺节点自主研发的Arm CPU,人工智能服务器的建设将同时推动台积电供应链中人工智能服务器计算ASIC和CPU两大环节的需求增长。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。