定制内存的不同实现路径

HBM4凭借 2048 位接口与高数据传输速率,将带来前所未有的带宽。但对于需要更高带宽与更大容量的应用,行业正在研发多种定制化内存方案。本文将介绍创意电子(GUC)、美满电子(Marvell)、三星与比利时微电子研究中心(imec)推出的定制内存解决方案,其中包括HBM-on-top-of-logic。

美满电子定制DRAM

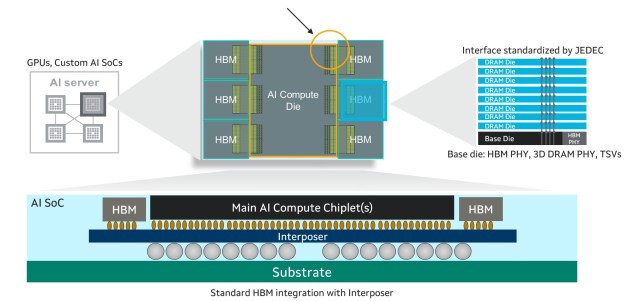

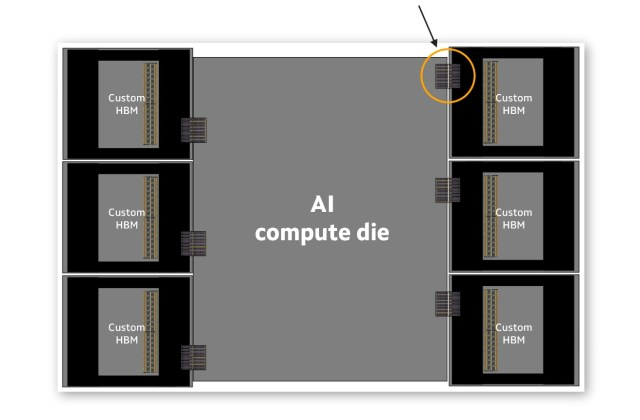

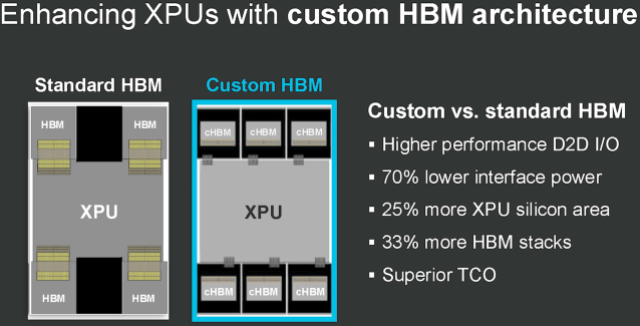

美满是较早推出定制处理器的厂商之一(该公司称之为XPU,以强调其为加速器而非 GPU),并率先公开了定制HBM4E内存的技术路线。由美满设计的 XPU 平台,很可能成为首批采用美光、三星或SK海力士生产的定制 HBM4E DRAM 的产品。

美满面向 AI 加速器的定制 DRAM 架构,用自研32-GT/s 512 位双向裸片间(D2D)接口,替代了传统占用面积较大的 2048 位 HBM4 物理层(PHY);该接口速率最高可达 32GT/s,并将内存控制器迁移到 DRAM 堆叠下方的定制基底裸片中。堆叠内的 DRAM 器件仍符合JEDEC 标准(即 HBM4E),整体堆叠也保持 JEDEC 规定的几何尺寸规格,因此美满的客户无需担心使用昂贵的专用内存器件,或采用非标准高度的内存堆叠。

美满电子 CXL、定制 HBM、内存与存储产品营销高级总监Khurram Malik表示:“我们希望充分利用 JEDEC 已在 DRAM 堆叠方面完成的所有工作。从 DRAM 堆叠来看,它完全兼容 JEDEC 标准;DRAM 堆叠是标准 HBM4E,定制化仅发生在基底裸片与计算裸片的接口部分。”

Rambus 硅 IP 产品管理总监Nidish Kamath补充:“即便使用定制接口,DRAM 器件、生产方式、电气规格与尺寸仍受 JEDEC 标准约束。DRAM 层、物理尺寸与电气特性均标准化,以确保可用性与可靠性。变化的只是基底裸片与主机的通信方式,可以是专用方案(如大量直连布线),也可以基于标准(如通过 UCIe 采用封包格式)。这种分离有助于维持供应链稳定,同时在逻辑层实现差异化。”

将标准 2048 位 HBM4E PHY 从计算裸片中移除,替换为美满自研 32GT/s 双向 D2D 接口后,相比标准 HBM 方案可释放多达 25% 的 SoC 面积用于计算硬件;内存 I/O 功耗降低45%~70%(视场景而定);SoC 支持的内存容量提升33%;通过缩小裸片面积降低 SoC 成本。

此外,美满的定制 HBM4E DRAM 架构还能提供高于 JEDEC 标准 HBM4E 的峰值带宽。一组标准 HBM4E 堆叠(12GT/s、2048 位):最高3.072TB/s,一组美满定制 HBM4E 堆叠(32GT/s、512 位):2.048TB/s,四组堆叠不仅容量提升 4 倍,在相同 2048 位接口下带宽达到8.192TB/s,为标准方案的2.66 倍。

物理层方面,美满的 D2D 链路每通道双向速率达64GT/s(收发各 32GT/s),在 2nm/3nm 工艺节点下可实现超过30Tb/s/mm的带宽密度,显著高于当前一代 UCIe 链路。该 IP 集成通道冗余与自动修复、ECC、RAS 功能,以及适配突发流量的自适应功耗控制。出于竞争考量,美满未过多披露其专用接口细节。

Malik 表示:“该方案包含增强型 ECC、先进 RAS 遥测与可靠性引擎。我们不会公开具体的信令或编码方式,但这些特性对实现如此高速运行至关重要。”

美满以交钥匙方案形式交付定制 HBM4E 内存,包含应用桥接、链路层与物理互联,基于 2nm/3nm 级工艺实现。公司强调,可在定制基底裸片中集成额外功能,让计算更贴近内存。

Malik 称:“如果超大规模云厂商希望在基底裸片中加入部分计算或逻辑能力以实现加速,就需要定制化。在容量需求更高的场景,客户都在研究如何让加速更贴近内存。”Malik 拒绝透露有多少客户正在采用该专用 D2D 接口开发 XPU,或在基底裸片中集成特定加速器的定制 HBM4E 内存,但可以确定相关项目已在推进中。

创意电子DRAM-on-Logic(DoL)

创意电子的DRAM-on-Logic(DoL) 是极具创新性的内存技术。该方案来自专业芯片设计服务公司,定位独特,并基于台积电SoIC 混合键合工艺实现。

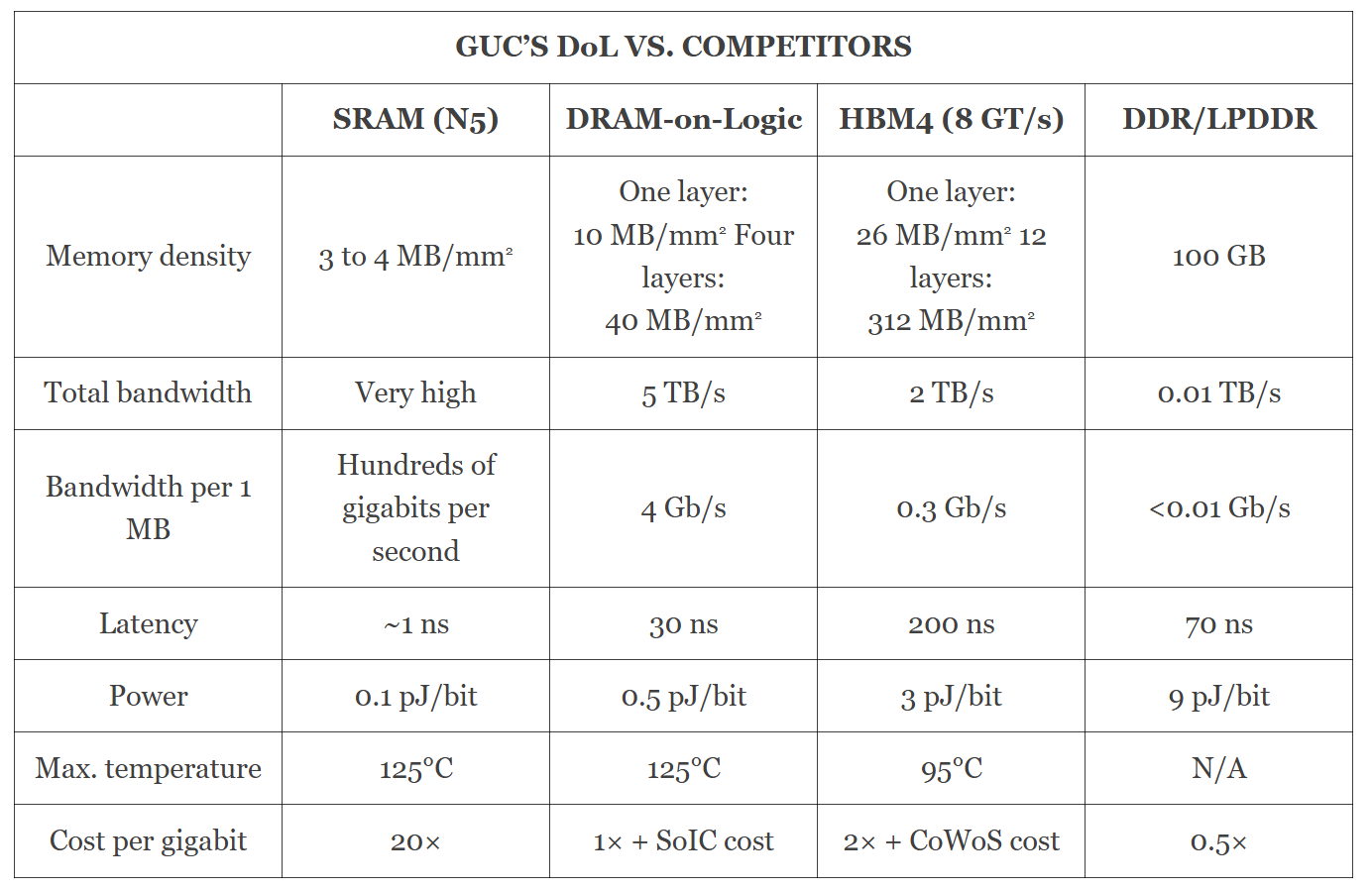

尽管创意电子正式将 DoL 定位在内存层级中的片上 SRAM 与封装外 HBM 之间,但从性能、功耗与成本数据来看,DoL 并非主要为与 HBM 或 DDR 共存的混合内存子系统而设计;相反,它更适合作为近计算工作内存层,速度快于 HBM4,可在更看重带宽而非容量的场景中替代 HBM。

GUC DoL 与竞品对比(关键指标)

创意电子的实现方案中,4~8 层定制 DRAM 层直接垂直键合在计算裸片上方,省去行业标准的外部内存接口、PHY 与 SerDes,释放面积用于计算硬件。据创意电子在论坛上公布的数据,该结构可提供约5TB/s带宽(比 HBM4 快一倍)、30ns延迟,能效约0.5pJ/bit。

密度方面,DoL 可达10~40MB/mm²(取决于堆叠高度),单器件容量达数十 GB,足以满足多数 AI 推理与网络负载。这类场景更受带宽与功耗约束,而非 raw 容量。对这些应用而言,HBM4 的架构与成本效益远不如 DoL;HBM4 容量更大,但延迟更高、带宽更低、成本更高。HBM4 因密度优势,仍将是需要数百 GB 内存的先进模型训练与超大模型的必备选择;但在越来越多的加速器中,DoL 可作为主力高性能内存。需要额外容量的系统可构建 DoL+DDR/LPDDR 混合内存子系统,但其普及程度仍待观察。

成本与集成方面,GUC 将 DoL 定位为约 “1 倍 + SoIC 成本”/Gb,对比 HBM4 的 “2 倍 + CoWoS 成本” 与 SRAM 的约 20 倍。垂直堆叠结构让内存垂直扩展,不占用大量裸片或中介层面积,并可享受 SoC 的全部功耗优化。

但 DoL 也存在挑战:内存需与逻辑精准对准,制造工艺必须消除微小偏差,需谨慎选择工艺节点。理论上可行,但大规模量产良率尚不明确,低良率意味着高成本。

拥有多项内存专利的 DataSecure CTO、Boolean Labs CTO 兼首席科学家Michael Schuette表示:“逻辑上堆叠 DRAM 理论上非常理想,但这涉及两种不同制造工艺,几何尺寸越小,不同模块对准难度越大。”

此外,尚不清楚 DoL 能否在与逻辑组装前单独测试 DRAM 层。若无法实现,一层坏片可能导致整个组件报废,推高成本并降低技术吸引力,类似上世纪 90 年代末至 2010 年代初 RDRAM 的遭遇。

Schuette 指出:“Rambus 的 RDRAM 串行架构不允许单独测试芯片,只能测试整个模组。只要有一行内存损坏,整个模组都要报废,因为无法定位坏芯片。”

三星 SAINT-D

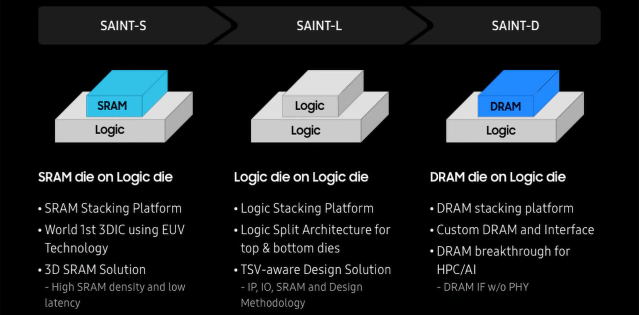

创意电子并非唯一提出逻辑上堆叠 DRAM 的厂商,这种架构能带来传统 DRAM 或 HBM 与处理器并排布局无法实现的优势。三星将逻辑上堆叠 DRAM(DoL) 集成纳入其三星先进互联技术(SAINT) 3D 堆叠平台,包括:

- SAINT-S:SRAM-on-logic

- SAINT-L:logic-on-logic

- SAINT-D:DRAM-on-logic,将 HBM/DRAM 垂直堆叠在 CPU/GPU 之上

顾名思义,SAINT-D 是一套 DRAM 堆叠平台,为追求垂直内存集成的系统级封装开发者提供丰富选项。它支持定制 DRAM、HBM 或通用 DRAM 集成,比面向特定应用的 GUC DoL 更灵活。三星将 SAINT-D 作为交钥匙服务的一部分,整合晶圆代工、先进封装与内存业务;这种一站式方案是其独特优势,三星内部生产所有组件,可全面优化以实现最佳效果,尤其是 HBM4 垂直集成极具挑战性。

逻辑上堆 HBM4

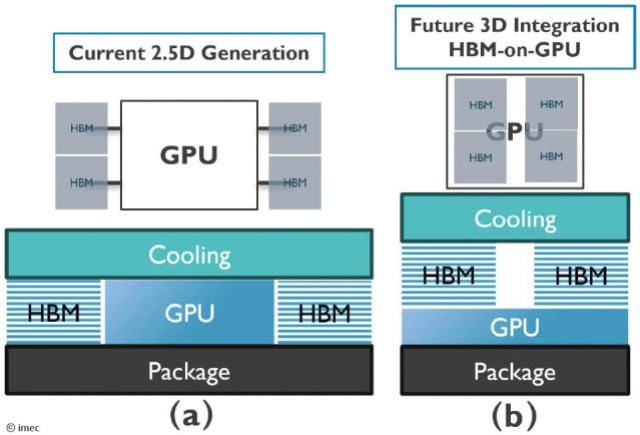

为提升性能,HBM4 将接口拓宽至2048 位,约 5500 个超高引脚数使其通过中介层与重布线层连接主机处理器的复杂度大幅提升。因此业界普遍认为,将 HBM4 直接堆叠在主机处理器上方并通过混合键合连接更为合理。但 HBM 堆叠是 AI 加速器封装中的主要热源之一,垂直堆叠会显著提升局部功耗密度与热阻,形成严重散热瓶颈。

Rambus 院士、杰出发明家Steven Woo表示:“将 HBM 直接堆叠在处理器上方一直是个吸引人的想法,但仍面临现实挑战。散热、供电与良率问题使其难以大规模集成,尤其是在逻辑与内存密度持续提升的情况下。行业仍在采用 2.5D 先进封装或小芯片方案实现并排集成,这些方案能提供高带宽,同时避免 3D 堆叠带来的散热、供电与制造挑战。”

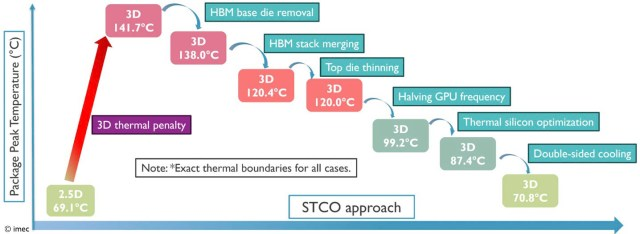

根据 imec 2025 年底发表的论文,在无缓解措施下,模拟的3D HBM-on-GPU方案(GPU 上方堆叠 4 组 12 层 HBM,通过微凸块连接,上方散热)GPU 峰值温度达141.7°C;而同散热条件下传统 2.5D HBM 环绕 GPU 设计仅69.1°C,远超 GPU 逻辑(约 105°C)与 DRAM(95°C)的安全工作上限。

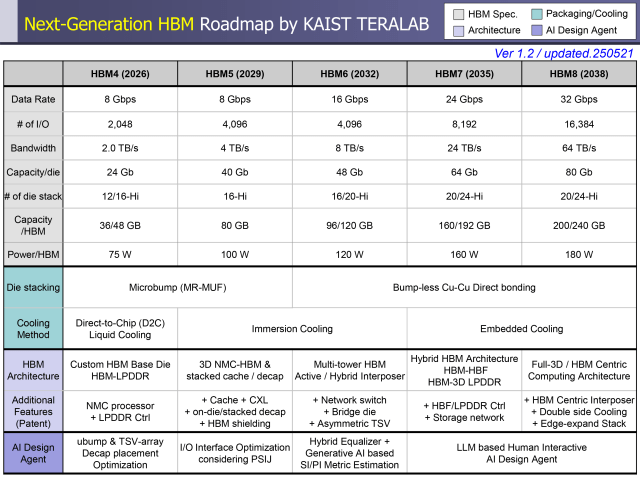

韩国科学技术院(KAIST)估算,一组 12 层 / 16 层 HBM4 堆叠功耗约75W,尺寸 10.5×12.0mm;未来 HBM 版本热设计功耗还将上升。4 组 HBM4 堆叠满载功耗约300W,搭配 400W ASIC(如 GB200/GB300 所用),750mm² 左右的 3D 堆叠处理器总功耗可达700W,散热难度极大。

Woo 质疑:“下方的逻辑裸片本身就是热源,如何将热量有效导出,并保证内存数据的完整性与可靠性?DRAM 堆叠并不耐高温,存储数据的位单元漏电会加快。”

为解决 3D 堆叠 HBM 的散热挑战,imec 在跨技术协同优化(XTCO) 项目中提出多重强效缓解方案,包括GPU 频率减半(降温 20.8°C)、合并 HBM 堆叠(降温 17.6°C)、双面散热(降温 16.6°C)。

综合 XTCO 措施可将 3D 堆叠 HBM 处理器温度降低约一半,但会带来显著性能损失,并要求 DRAM 厂商修改 HBM 设计(可能影响良率与供应链),同时需改进散热方案。

imec 系统技术项目总监James Myers表示:“将 GPU 核心频率减半使峰值温度从 120°C 降至 100°C 以下,达到内存运行的关键目标。尽管这会带来 28% 的工作负载损失(AI 训练步骤变慢),但 3D 架构的更高吞吐密度使整体封装性能优于 2.5D 基线。我们正用该方法研究其他 GPU/HBM 配置(如 GPU 置于 HBM 上方),以应对未来散热约束。”

AI 或高性能计算处理器厂商是否会将 HBM4、HBM4E 或 C-HBM4E 3D 堆叠在设计中,仍有待观察;但 Rambus 预计,受散热影响的架构设计将在未来更普遍。

Kamath 称:“逻辑上堆叠内存是一项挑战,需要权衡 —— 在保证 DRAM 可靠工作温度范围内,能做多少优化。但行业趋势已经显现:物理设计约束正影响处理器架构,散热与热效应正在左右处理器与内存两侧的架构决策,未来这类决策会越来越多。”

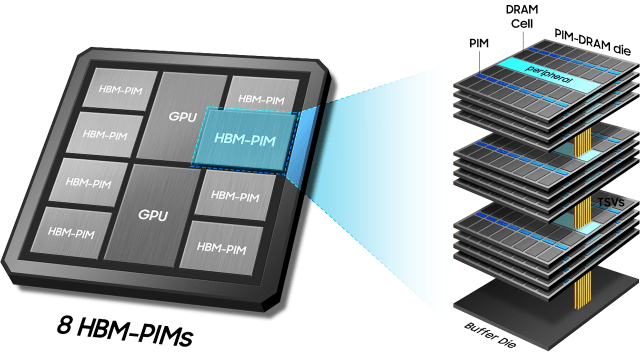

内存与逻辑融合:Automata、HBM-PIM、GDDR6-AIM

将定制逻辑集成到内存芯片并非全新概念。美光 2014 年推出 Automata Processor,三星与SK海力士在 2020 年代初尝试HBM-PIM(内存内处理器) 与GDDR6-AIM(内存内加速器)。将基础计算能力放在内存附近具有充分合理性,可降低内存带宽需求并最终减少功耗。

Schuette 表示:“理想情况下,我们需要某种‘内存内处理’,即智能芯片能感知内存内容,或至少具备提取特征的能力。这样可将对主机处理器的总带宽需求降低约 90%。可以在内存中嵌入处理器,完成模式识别、图像分析等预处理,再将数据送往主处理器。”

但这三项技术均未普及,原因在于目标负载过于细分或误判瓶颈。Automata Processor 在 DRAM 中集成大量并行有限状态机,加速模式匹配、正则表达式与图遍历,但领域外几乎无法使用,且需要专用工具链、编译器与熟悉自动机理论的开发者。

三星 HBM-PIM 与SK海力士 GDDR6-AIM,概念不同但目标一致,通过在 HBM 堆叠中集成简单计算单元减少数据移动(功耗高昂)。三星 PIM 将计算单元集成到内存层,SK海力士 AIM 集成到内存库。但 GPU 在多数目标负载上已提供足够性能,且拥有成熟生态(CUDA、cuDNN、PyTorch),使得小众加速器即便在特定任务上加速显著,也缺乏经济与运营吸引力。

归根结底,当前 AI 负载围绕密集张量运算展开,而 Automata、PIM、AIM 解决的是不规则访问、规则处理或模式匹配等 “过去的问题”。

此外,美光、三星、SK海力士等内存厂商更擅长规模化销售标准化、高利润的 HBM,其商业模式不适合为小众架构投入资金,制造工艺也更适合生产规则重复的 DRAM 阵列而非逻辑电路。因此,尽管内存内集成逻辑在技术上很优雅,但缺乏软件支持导致商业可行性不足。

不过 Schuette 认为,随着 C-HBM4E、美满定制 HBM4E 等技术依托行业标准与规模效应出现,近内存乃至内存内处理的实现成功率比以往更高。他表示:“市场需要的是能生成自定义元数据的内存加速器,为非结构化数据赋予结构,并与数据一起存储,从而搜索结构而非原始数据。这需要一定处理能力,但不必实时执行,理论上可在空闲时间后台完成。”例如,谷歌、Meta 等超大规模云厂商可在自研 AI 加速器的内存子系统中嵌入定制内存/近内存加速器,进一步优化软硬件栈。

Schuette 总结:“这才是行业应该做的。但不能简单地把加速器塞进 HBM 就指望它解决所有问题,必须理解数据本质、提取有效特征,才能让它真正可用。”

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。