SRAM,遇到困难

SRAM 是所有计算系统的重要组成部分,但它未能跟上逻辑电路的扩展步伐,造成了越来越棘手的问题,而这些问题在过去五年中变得更加严重。

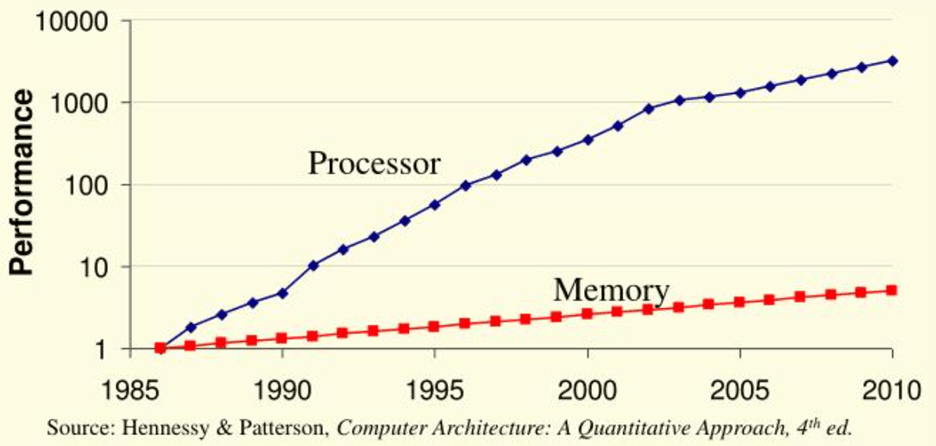

早在1990年,亨尼西和帕特森就出版了《计算机体系结构:量化方法》一书。作者当时就已清楚地认识到,内存容量和性能将成为未来处理能力发展的关键瓶颈(见图1)。几十年来,硬件架构一直在回避这个问题,通常使用SRAM作为缓存,并辅以容量更大的片外DRAM。虽然这使得内存看起来更大,但速度往往慢得多。这就是所谓的“内存墙”。

图 1:内存墙的早期识别。来源:Hennessy & Patterson,《计算机体系结构:定量方法》。

在所有计算形式中,程序和数据都存储在静态随机存取存储器(SRAM)中。处理器从该存储器中读取指令。这些指令告诉处理器要对同样存储在该存储器中的数据执行哪些操作。

SRAM 比处理器内部临时存储数据的寄存器更便宜。虽然寄存器单元可以使用与 SRAM 相同数量的晶体管,但寄存器使用更昂贵的解码和访问机制,这种机制无法随着寄存器组大小的增加而扩展。

SRAM 存储器由一系列存储单元组成,周围环绕着电路,这些电路能够以随机方式读取和存储数据。在许多情况下,周围的逻辑电路是半定制的,因为它会随着存储阵列规模的增大而变化。事实上,许多存储器速度的提升都来自于这些电路的改进,而不是存储阵列本身的改进。

随着SRAM容量和性能的提升几乎停滞不前,未来前景愈发黯淡。这意味着,随着制程节点的不断缩小,相同容量的SRAM所占用的芯片面积比例却越来越高。随着越来越多的芯片达到光刻工艺的极限,这种状况难以承受,制造商不得不比以往更多地依赖外部存储器。而外部存储器的速度要慢得多。

在人工智能时代,访问模式发生了变化,这也迅速成为主要的限制因素。

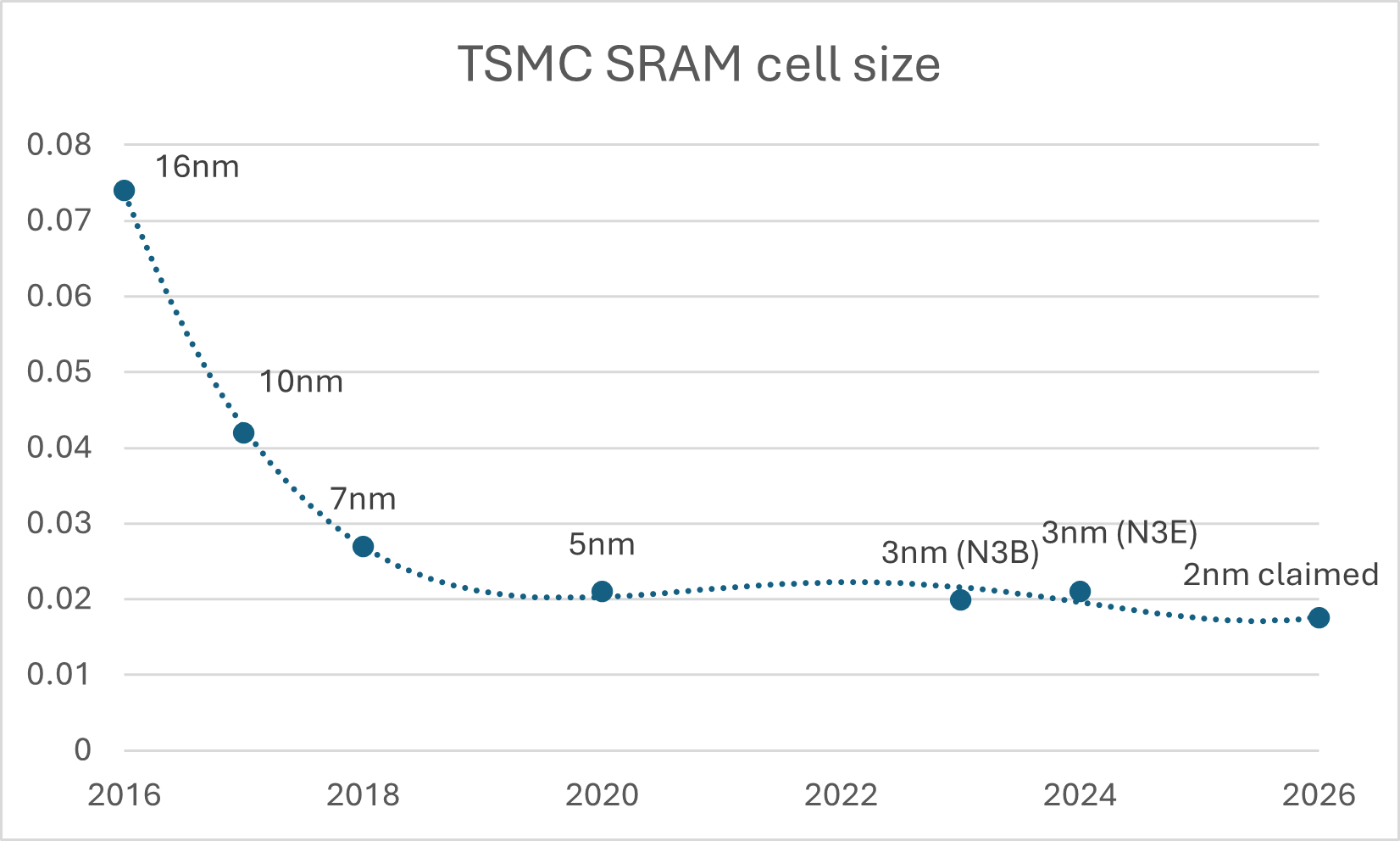

台积电承认SRAM微缩存在一些问题,但该公司声称其新的2nm纳米片技术(见图2)已有所改进。然而,很难获得确凿的数据来支持这一说法。过去,实际结果往往低于大规模应用前公布的数据。

图 2:台积电 SRAM 单元尺寸(数据来自公开渠道)。来源:半导体工程

虽然这可以被视为内存问题,但归根结底是计算问题。“性能并非受限于计算能力,” Eliyan的首席执行官兼联合创始人 Ramin Farjadrad 表示,“在很多情况下,大多数功能的处理器利用率只有 20%,甚至更低。性能主要受限于内存和内存带宽。这就是所谓的内存墙。”

SRAM 微缩

人们很容易认为,当晶体管尺寸缩小时,由六个晶体管组成的 SRAM 单元的尺寸和性能也会随之降低。“SRAM 微缩停滞不前,是因为传统的 6T 位单元达到了物理极限和工艺偏差极限,” Synopsys嵌入式存储器 IP 首席产品经理 Daryl Seitzer 表示。“SRAM 位单元的设计初衷是实现高密度存储,但它存在一个固有的缺陷,即读写需求相互冲突。访问晶体管与存储晶体管之间存在竞争,这种竞争需要仔细平衡,并考虑工艺偏差。随着几何尺寸的缩小,工艺偏差对位单元读写特性的影响比例会越来越大。”

问题远不止于此。“随着制程节点的缩小,静电控制和随机波动成为主要制约因素,阻碍了单元面积的相应缩小,” Arteris产品管理高级经理 Andre Bonnardot 表示。“此外,由于导线电阻和位线电容的增加,SRAM 的速度已经达到瓶颈,而 Vdd 在最近的制程节点中几乎没有降低。逻辑电路可以通过器件和布线方面的创新继续缩小尺寸,但 SRAM 却无法做到这一点。”

随着制程节点的更新,这些问题愈发严重。“在先进的2nm及以下制程工艺上,SRAM位单元的密度提升幅度已降至不足15%。” Cadence硅解决方案集团研究员Gopi Ranganathan表示,“这远低于我们在65nm到5nm工艺技术迭代过程中所经历的50%到100%的逐代缩小幅度。这种下降可归因于先进制程节点上器件、栅极触点、MEOL以及V0/V1的尺寸极其狭窄,而进一步有意义的尺寸缩小受到工具的限制以及硅良率的制约。”

其影响是成本更高、性能更低。“主要表现为存储器密度扩展速度落后于传统存储器,” Quadric首席技术官 Nigel Drego 表示。“每平方毫米门数(Gate/mm²)的发展速度超过了每平方毫米兆字节数 (MB/mm² )。此外,由于线路延迟和物理定律与 SoC 设计人员的需求不符,访问速度也受到影响。然而,巧妙的架构调整可以缓解逻辑和 SRAM 速度之间的依赖性。”

自 20 世纪 80 年代以来,这种差距一直在扩大,那么如今的计算机技术与二十年前相比如何呢?Eliyan 公司的 Farjadrad 表示:“计算机或处理器的性能提升了近五个数量级。但这些计算机需要处理来自内存的数据。内存带宽甚至没有提升 100 倍,因此,计算机实际处理或能够处理的数据量与实际输入的数据量之间存在超过 1000 倍的差距。”

这不仅仅是前沿人工智能技术的问题。最终,它将影响到所有领域——甚至包括小型微控制器(MCU)和微处理器(MPU)——尤其是在人工智能向边缘应用发展的过程中。“在某种程度上,它变得无法扩展,届时SRAM将占据芯片总面积的更大比例,”瑞萨电子首席产品营销经理Kavita Char表示。“这是我们必须考虑的问题。这也会影响芯片用户,因为他们必须考虑哪些功能可以在芯片上实现,以及何时需要使用外部存储器。随着芯片几何尺寸的缩小,成本也会越来越高。”

目前尚不清楚N2的位单元面积是否比上一代产品更优。“SRAM近期的性能提升主要得益于逻辑电路尺寸的缩小,并将其应用于SRAM宏的解码和控制电路,”Synopsys嵌入式存储器IP高级产品经理Rahul Thukral表示。“这需要设计上的创新,而我们能够在位单元尺寸未缩小的情况下实现这样的面积优势。随着环栅(GAA)技术的改进以及器件宽度控制灵活性的提高,预计未来性能将进一步提升。GAA晶体管能够提供更好的静电控制,从而降低漏电并改善读写性能,预计还将带来更多改进。对于最初的2nm工艺,存储器面积正在改善,其中大部分性能提升来自解码和数据通路电路中的逻辑器件。然而,随着GAA晶体管的进一步缩小,位单元面积有望进一步缩小,预计在后续节点中位单元面积将进一步降低。”

Arteris公司的Bonnardot表示:“我们认为SRAM扩展速度的放缓正处于系统架构的拐点。当内存密度增长放缓时,简单地增加缓存就变得不经济了。”

对软件的影响

对软件的影响范围广泛,挑战了长期以来“软件生产力是优化最重要的目标”这一观念。如今,许多领域都在质疑这一观点,尤其是在越来越多的产品走向软件定义化之后。“依赖于海量本地SRAM和多层快速缓存的处理器架构将受到最大的影响,”Quadric公司的Drego表示。“CPU无法避免这些硬件密集型的内存架构,因为我们手机、笔记本电脑和数据中心中的CPU被设计用于运行具有非结构化内存引用的随机用户代码,并同时处理数十个线程。”

对于这类公司而言,选择余地不多。“SRAM 现在占据了芯片面积和成本的更大比例,”Bonnardot 表示。“大型寄存器文件和缓存层次结构不再能够自由扩展,这加大了对芯片尺寸、良率、能效和数据传输效率的压力。这使得瓶颈从计算密度转移到了内存架构和互连效率。软件必须假定内存的层次结构更加复杂,速度也更加分散。局部性、分块、分区和流量可预测性变得更加重要,而延迟差异则成为系统级性能的限制因素。”

人工智能也无法摆脱这些问题。“随着人工智能模型规模和上下文长度的增长,内存带宽和片上缓存成为性能瓶颈,”Synopsys公司的Seitzer表示。“这在LLM推理中表现得尤为明显,键值缓存带宽成为瓶颈。因此,软件必须优化数据局部性、内存感知调度、量化、稀疏性和内存分层,因为计算能力的提升已无法弥补内存扩展速度的缓慢。”

人工智能架构的一些差异可以被利用。“人工智能引擎,尤其是人工智能推理处理器,可以长时间处理结构良好的代码,其运行时间比频繁切换任务的CPU长几个数量级,”Drego说道。“智能人工智能架构将内存管理推入离线编译器,这些编译器可以调度显式的代码驱动的DMA传输,用于传输人工智能模型的权重和激活值。整个人工智能推理处理引擎都可以构建成不需要任何数据缓存的架构。这减轻了使用最高速度、最高功耗的SRAM来设计分层缓存、缓存标签和转换缓冲区的压力。随着越来越多的工作负载依赖于人工智能模型,先进SoC芯片面积中越来越大的部分可以避免SRAM密度/速度瓶颈,从而将这一设计挑战限制在关键的CPU子模块中。”

或许业内并非所有人都注意到了这一点。“对于人工智能模型来说,有一个叫做算术强度的概念,”Eliyan公司的Farjadrad说道,“它指的是处理器在内存上运行的函数或操作的数量。遗憾的是,近期人工智能模型的算术强度远低于以往。因此,从内存到处理器的带宽需求更大了。”

3D SRAM

如果 SRAM 无法扩展,那么使用最昂贵的工艺节点就毫无意义。目前,人们越来越倾向于将 SRAM 集成到芯片上,并安装在处理器之上。Cadence 公司的 Ranganathan 表示:“SoC 设计人员正在探索解耦方案,即将少量 SRAM 放置在采用最先进工艺节点设计的芯片上。最关键的需求是 CPU/GPU/AI 工作负载,例如 1 级、2 级甚至 3 级。在这种情况下,更大的 SRAM 容量(例如 4 级)则放置在更早工艺节点的芯片上,从而降低每个晶体管的成本。更快的芯片间通信链路和更小的互连间距的出现,使得多存储器层次结构的集成更加容易,从而在合理的延迟影响下降低成本。”

目前,这是一种成本高昂的解决方案。“由于封装成本高、散热复杂且标准化程度有限,基于3D和芯片组的SRAM目前仅适用于高端AI/HPC芯片,”Seitzer表示。“如今,SRAM密集型芯片组仍然集中在高端设备中,需要通过定制解决方案将SRAM与其他高价值IP集成在一起。短期内实现低成本、面向大众市场的SRAM芯片组似乎不太可能。”

但那一天或许终会到来。“芯片组(Chiplets)提供了一种绝佳的解决方案,能够以更低的功耗实现更高的带宽,”Farjadrad说道。“每个人都需要让它发挥作用,这就是为什么整个行业如此关注解决这些挑战的原因。这才是打破性能瓶颈的途径,不仅适用于2.5D,也适用于3D。”

替代方案

每当内存出现问题时,人们总会讨论可以用哪些新型内存技术来替代SRAM。“新兴技术在某些特定情况下有所帮助,但它们并不能完全替代SRAM,”Bonnardot说道。“未来的大多数系统将会使用更多层级的内存,而不是更少。”

未来的系统架构也可能有所不同。“内存计算或近内存计算的概念,正是人工智能的发展方向,这意味着传统模型将会发生一些变化,” Baya Systems首席商务官Nandan Nayampally表示。“传统模型围绕着庞大的计算引擎构建,这些引擎试图从相对靠近内存的位置提取数据。因此,系统将持续演进,开始使用不同的存储器,因为我们最终可以说SRAM已经无法扩展。这是一种看待问题的方式。另一种看待问题的方式是,我们目前使用SRAM的方式是否已经达到了架构上的极限?我认为后一种情况更为明显。Cerebras在晶圆级应用方面迈出了重要一步,即将更多的存储器集中在芯片上,从而改变了一些限制。”

即使有了这些进步,单个芯片上可容纳的模型尺寸仍然有限。“这就引出了一个主要问题:‘在一片晶圆上究竟能高效地实现什么?’ 如果开始堆叠晶圆或生产更大的晶圆,这种架构还能继续正常扩展吗?还是最终会遇到同样的限制?所谓的‘内存墙’并非一次性的障碍,”纳亚姆帕利说道。 “如果架构保持不变,模型尺寸的每一次增大都会带来新的障碍。因此,设计决策必须着重考虑系统的可扩展性,从单芯片到多芯片乃至更大范围。最初,我们看到的是CPU集群。后来是芯片组集群。再后来,发展到板级集群。如今,扩展意味着要让整个机架作为一个统一的计算资源运行,甚至更进一步。在每个阶段,无论是纳米级、毫米级、厘米级、米级还是公里级,都会出现新的挑战。最终,如何划分和管理资源决定了你克服这些反复出现的障碍的能力。”

新型存储器也正在站稳脚跟。“一些新兴的嵌入式存储器确实展现出了真正的市场吸引力,尤其是在SRAM或嵌入式闪存难以胜任的领域,”Seitzer说道。“例如,MRAM具有良好的可扩展性、低泄漏、高耐久性,有望取代SoC中的部分嵌入式闪存/SRAM。ReRAM由于易于集成和成本较低,正被越来越多地采用,成为一种更经济高效的嵌入式非易失性存储技术。这些技术可以增强而非取代L1/L2缓存中的高性能SRAM,但它们有望取代某些控制器、MCU和加速器中的嵌入式存储器。”

高带宽内存 (HBM) 备受关注,它显著提升了 DRAM 的带宽。HBM 由多层 DRAM 堆叠而成,其底层传统上是与处理器直接连接的芯片级物理层 (PHY)。由于底层芯片采用了与位单元层相同的工艺技术——一种针对存储单元而非逻辑电路优化的工艺——因此其功耗密度和热密度受到限制。如果将底层芯片的工艺升级为针对逻辑电路优化的工艺,则可以支持更多潜在功能并实现更高的性能。

“通过这种方式,我们可以在HBM基片和GPU之间实现更高带宽的芯片间接口,”Farjadrad说道。“我们可以利用基片另一侧的剩余带宽来连接其他设备。这些额外设备可以是另一排HBM,从而使GPU可访问的HBM容量翻倍。或者,也可以将其用于I/O芯片组,以提供更高的外部带宽,或者两者兼而有之。”

此外,缓存管理方面也有了更大的空间。“在SRAM扩展不再自动的时代,架构效率,尤其是在结构和一致性层面,成为了每平方毫米性能和每瓦性能的关键所在,”Bonnardot说道。“通过智能地管理缓存位置和流量行为,缓存可以在不成比例增加SRAM面积的情况下,提供足够的内存容量和带宽提升。”

结论

内存瓶颈日益凸显,而且短期内几乎没有改变的迹象。SRAM 扩展不太可能重现昔日的辉煌,这意味着必须寻找替代方案。3D 堆叠技术可能会变得更加普及,尤其是在价格下降的情况下。但目前还没有万全之策。如果高速内存成为计算能力的瓶颈,那么计算就必须更有效地利用现有内存。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。