超越x86:GPU驱动型AI时代的CPU替代方案

人工智能的爆发,给数据中心带来了前所未有的高能耗工作负载。但目前绝大多数 AI 部署,仍沿用 “CPU + 加速器” 的经典服务器架构,以及统治市场数十年的 x86 指令集。当下的 AI 服务器,几乎清一色采用 GPU 与 x86 CPU 的组合方案,但这并不意味着 x86 是唯一的选择。

只要匹配恰当的工作负载与软件栈,非 x86 架构的 CPU 同样能高效运行 AI 任务,甚至有望在降低数据中心运营成本的同时,实现更高的可持续性。

AI 服务器的算力基石:除了 x86 还有哪些选择?

x86 架构之所以能成为服务器领域的事实标准,核心在于其构建了涵盖硬件、编译器、算法库及厂商支持的完整生态系统。但深究下来,多数 AI 工作负载其实并不依赖 x86 架构的专属特性。以下三类替代方案,正逐渐走进大众视野:

- ARM 架构:由英国 Arm 公司授权的专有精简指令集(RISC)架构,凭借低功耗优势在移动计算领域占据绝对主导地位,近年来在服务器市场的渗透率也持续攀升;

- RISC-V 架构:一种开源、模块化的精简指令集架构,支持高度定制化开发,兼具成本灵活性,尽管其商业生态系统规模尚小,但增长势头十分迅猛;

- ASIC(专用集成电路):为特定场景量身定制的芯片,能实现极致的每瓦性能比,但缺点同样突出 —— 设计与部署周期长、成本高昂,且不具备通用 CPU 的灵活适配能力。

相较于 x86,这三类方案均能在能效与散热表现上实现突破,而这两项特性,恰恰是高耗能、高散热需求的 AI 工作负载最核心的诉求。

AI 系统能耗账本:功耗都花在了哪里?

CPU 向来是功耗与发热大户,但在以模型训练为核心的 AI 系统中,GPU 才是名副其实的 “能耗主力军”。有意思的是,不少 GPU 产品已经集成了小型 RISC-V 控制器,专门负责管理类任务,而高强度的计算工作,则全部交由专用 GPU 核心完成。

由此可见,CPU 的选型虽然会影响系统总功耗,但系统功耗的下限,实则由 GPU 的能耗水平决定。

需要明确的是,硬件功耗会因具体型号、产品形态和工作负载的不同而存在较大差异。高端 x86 服务器 CPU 的热设计功耗(TDP)通常达到数百瓦,部分型号甚至在 350-500 瓦区间;而在许多设计方案中,ARM 服务器 CPU 能以更低的 TDP,提供同等甚至更高的核心数。

作为参考,英伟达 H100 GPU 在 PCIe 接口模式下功耗约为 350 瓦,切换至 SXM 高速互联配置后,功耗更是飙升至 700 瓦。

在搭载单颗 SXM 版 H100 GPU 的服务器中,若搭配高能效 ARM CPU,对比同配置下的高功耗 x86 CPU 方案,系统总功耗能实现显著下降。即便 GPU 依然是能耗核心,CPU 端的效率提升,也能有效降低整体功耗与散热压力。当然,实际节能效果最终仍取决于硬件型号、使用场景与系统设计。

关键变量:每瓦性能比与工作负载适配逻辑

要对不同架构 CPU 进行公平对比,并非易事 —— 功耗数据必须结合实际性能综合考量,而这背后存在两大核心变量:

1. 每瓦性能比高度依赖工作负载

如果 ARM 芯片在单核性能或向量运算能力上与 x86 存在差距,那么其低功耗优势就会被部分抵消;反之,针对特定任务优化的 ARM 或 RISC-V 设计,则能凭借精准适配,大幅提升整体运行效率。

2. CPU 利用率由 AI 技术栈决定

AI 计算流水线将任务卸载至 GPU 的比例,会直接影响 CPU 的能耗水平。比如数据预处理、模型编排、标记化、分片处理、I/O 调度和安全层校验等环节,都可能消耗大量 CPU 资源,具体的资源占用情况,则取决于技术栈的设计方案。

此外,软件生态与优化水平同样是关键因素。编译器成熟度、内核库完善度、运行时环境优化程度,都会直接影响不同架构 CPU 的绝对性能与能效表现。

因此,断言 ARM、RISC-V 等替代方案在能效上全面优于 x86 并不严谨。但可以肯定的是,在工作负载匹配度高、软件栈充分优化的场景下,替代架构确实能在能耗与散热效率上实现质的飞跃。

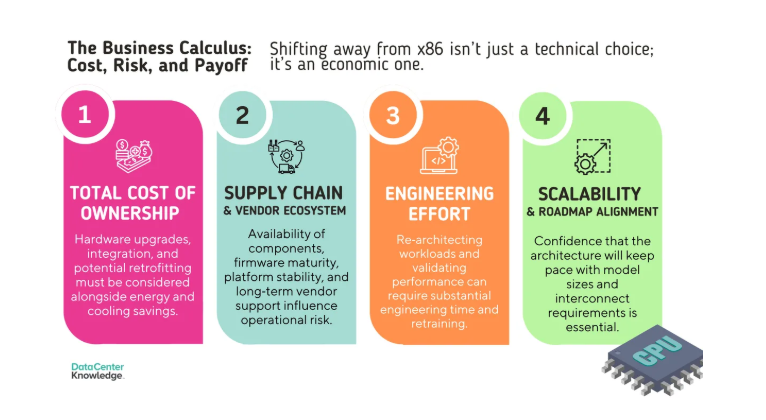

替代 CPU 架构能够在不牺牲性能的前提下,提升 AI 数据中心的能效与散热表现,但提升幅度的大小,完全取决于 CPU 的实际工作负载。对于企业而言,核心决策难题在于:通过节能降耗与散热优化所节省的成本,再加上潜在的性能收益,是否足以覆盖硬件采购、软件升级与组织架构调整所产生的支出。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。