使用“闪存”的AI计算消耗的功率仅为GPU的千分之一

从事闪存IP(知识产权)业务的Floadia公司正在开发CiM(内存计算)技术,该技术利用SONOS结构的闪存以超低功耗进行AI计算。Floadia 成立于 2011 年 4 月,由七名曾在瑞萨电子从事闪存开发工作 20 多年的工程师创立。其将应用BCD工艺的SONOS结构闪存(SONOS存储器)技术作为IP提供给半导体制造商和代工厂。

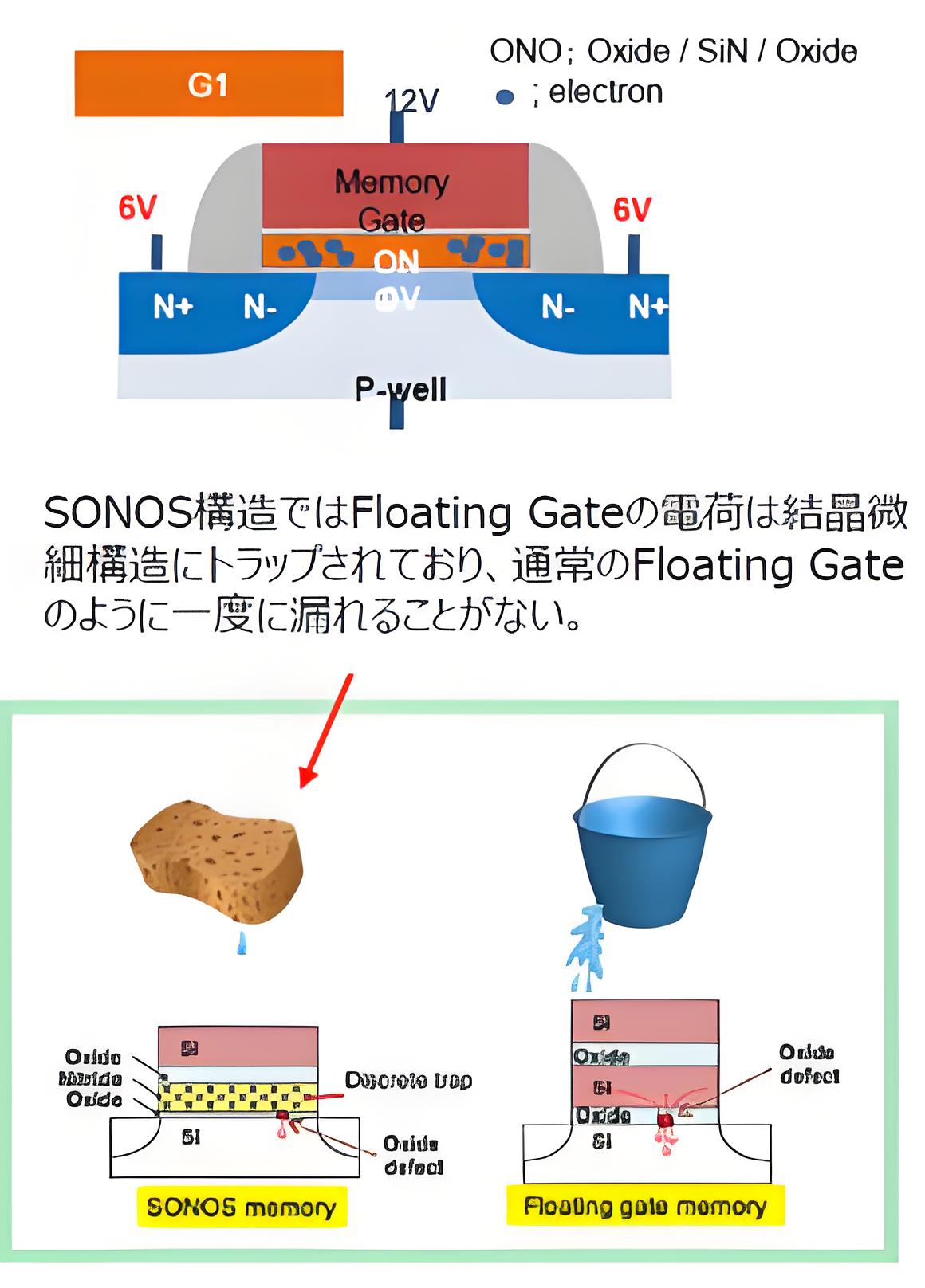

Froadia 的 SONOS 内存。 来源:Froadia

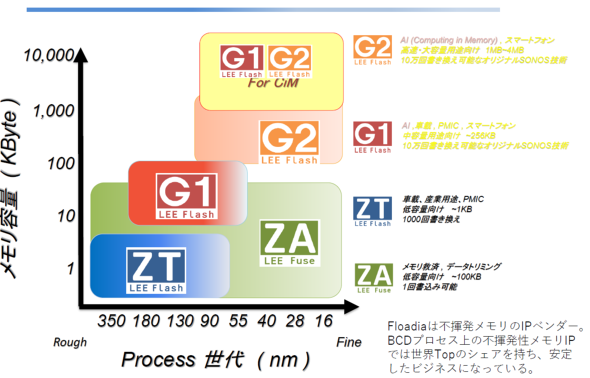

SONOS存储器是通过在氮化硅(SiN)薄膜中捕获电子(电荷捕获法)来实现记忆功能的。以往的采用浮栅方式的嵌入式闪存,由于栅极氧化膜易受高温影响,导致大量电荷泄漏,而SONOS存储器由于电荷被限制在微细的晶体结构中,因此不容易泄漏。这提供了出色的保留效果。目前,Floadia的主力产品为适用于高达256KB的中容量应用的“G1”,主要供应车载设备、电源管理IC(PMIC)、智能手机等。

Flowdia 的产品阵容和应用。 “G1”正在量产。来源:Flowdia

超低功耗,仅为GPU功耗的千分之一

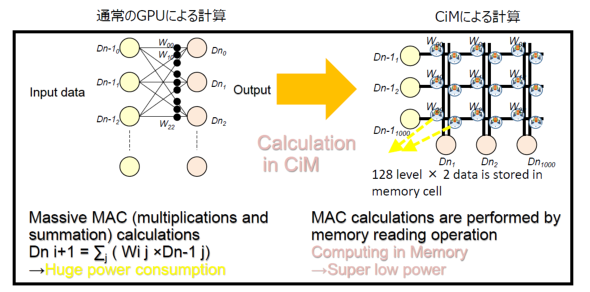

Froadia目前正在基于其通过SONOS内存培育的技术开发CiM技术。在 CiM 中,存储在存储单元中的加权系数和从字线施加的电压产生的电流在通过闪存时进行累积,然后在位线上相加以执行乘法和累积运算。 CiM 通过电流通过来执行像模拟电路一样的乘法和累积运算,而不是像 GPU 那样使用大规模数字电路。

它的原理简单,最大的特点就是能够以超低功耗进行神经网络计算,大约是GPU的千分之一(以TOPS/W来比较)。该公司市场部负责人兼首席营销官 Hideki Yoneda 表示:“由于流过存储单元的电流低至纳安级,因此可以制造出功耗极低的 AI 计算芯片。”

内存计算 (CIM) 原理。来源:Flowdia

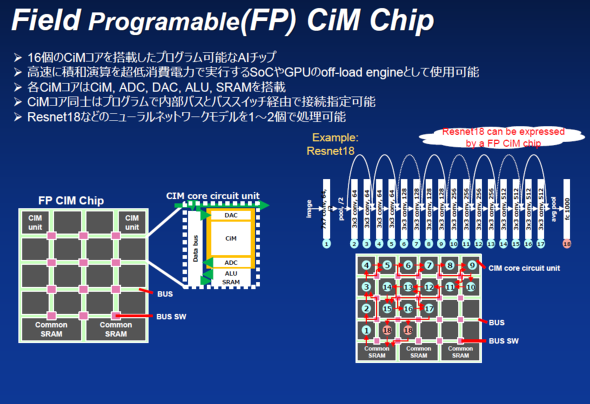

能够使用一到两块芯片处理 ResNet-18 的原型 AI 芯片

Floadia 目前正在制作“FP(现场可编程)CiM”的原型,这是一种可编程的 AI 芯片,通过将 CiM 排列成块并通过总线连接而制成。一个CiM(CiM核心)由1M位SONOS存储单元、运算电路、AD转换器、DA转换器、ALU、SRAM等组成。 CiM核心执行神经网络计算,并将结果依次传递到相邻的Tile继续进行计算。 “原型 FP CiM 配备了 16 个 CiM 核心,ResNet-18 的每一层都由一个 CiM 核心计算。像 ResNet-18 这样的神经网络模型可以用一到两个 FP CiM 来处理,”Yoneda 表示。 FP CiM原型芯片已经流片并正在进行评估。该游戏预计于2025年3月或4月发布。

CiM 核心配置和 FP CiM 概览。来源:Flowdia

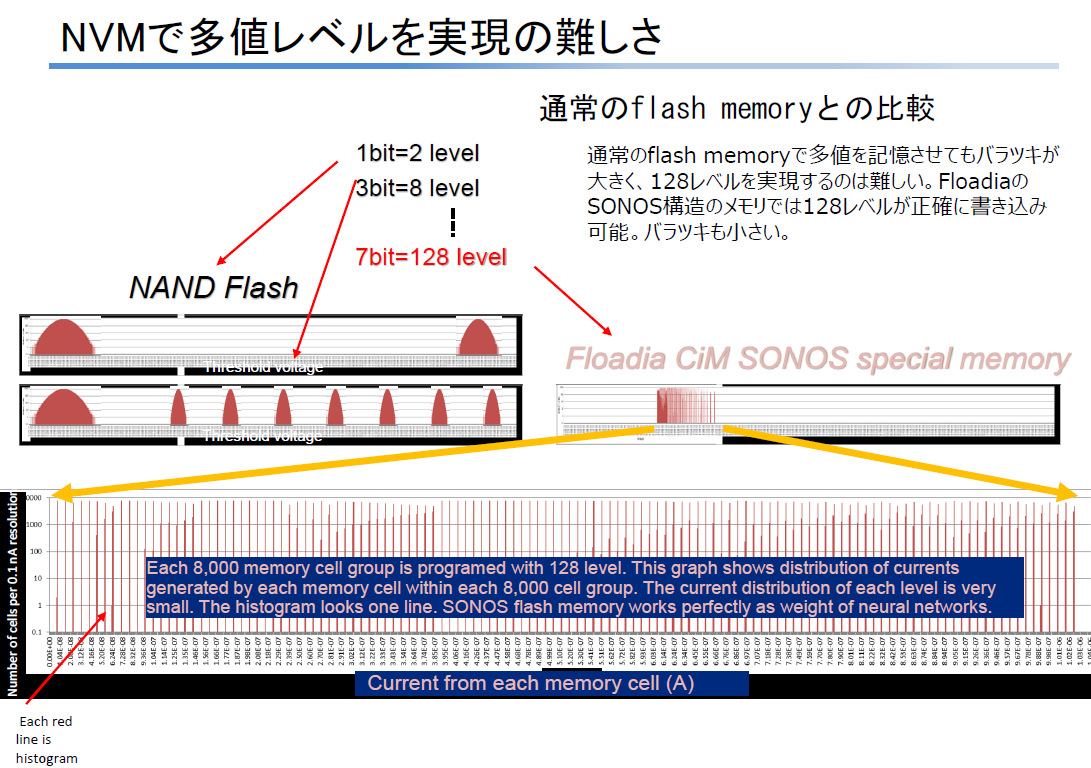

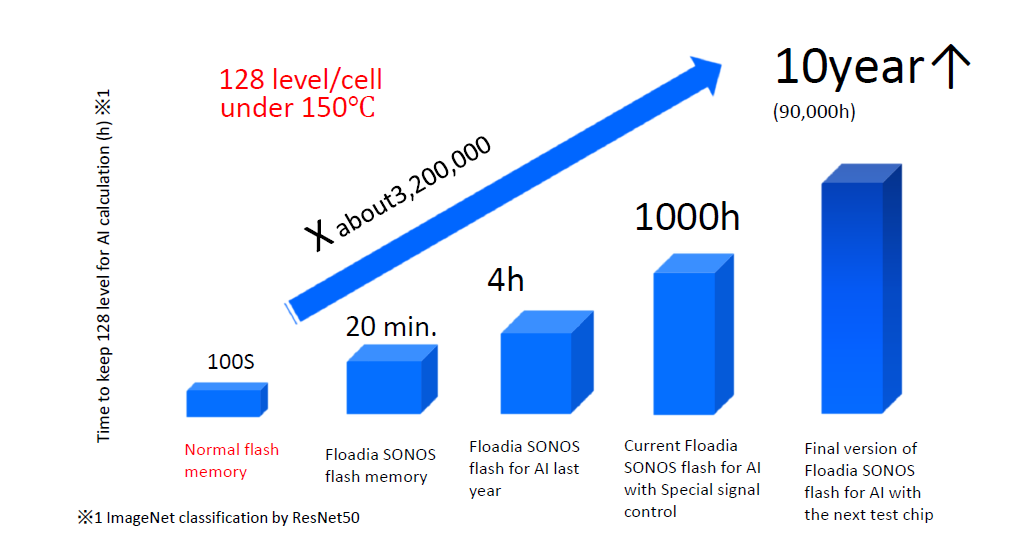

据称,目前正在开发的 FP CiM 具有出色的数据保留性能。 Flodia控制每个存储单元的电荷,实现128级(7位)的多值存储。此外,存储在存储单元中的128级系数数据可以长期保留。 “普通闪存单元只能保留数据 100 秒,但现在我们已确认它们可以保留数据 4 个小时。我们甚至看到了使用下一代 FP CiM 测试芯片保留数据 10 年的可能性,”Yoneda 说道。

Floadia的SONOS内存实现了128级(7位)的多值化。来源:Floadia

存储在存储单元中的 128 级系数数据可以长期保留。来源:Flowdia

Flodia 声称 FP CiM 并非旨在取代 GPU。 “它的定位是可以充当协处理器,作为执行高速乘法和累加运算的 SoC(片上系统)和 GPU 的卸载引擎,”Yoneda 说。

Floadia还参与了由日本新能源和工业技术发展组织(NEDO)牵头的项目 ,旨在开发能够实现高效、高速处理的AI芯片/下一代计算。九州工业大学、日立等公司参与了该项目。这也计划于 2025 年 3 月完成原型芯片。该技术适用于工业用途,例如在嘈杂环境中使用的传感器的降噪滤波器。

在掌上计算机上实现的 GPT-4 计算

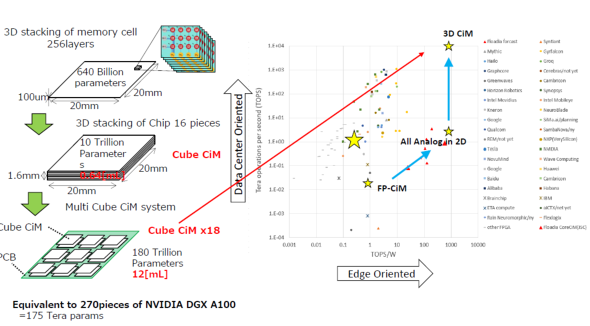

Flodia 的最终目标是以 3D 形式堆叠 CiM,使其能够配备大规模语言模型 (LLM),不仅针对推理,还针对学习。 “数据中心的关键在于可以安装多大的神经网络,因此二维实现最终会有一个极限。”Yoneda 说。

CiM的3D堆叠将分以下阶段开发:首先,我们通过堆叠256层NOR型SONOS存储器来创建一个芯片。考虑到用光罩可以制造的最大芯片尺寸,该芯片的尺寸假设为 20 x 20 毫米。 “Cube CiM”是一种由16个20毫米见方的芯片通过硅通孔(TSV)堆叠在一起的封装。最终产品将是安装在印刷电路板(PCB)上的 18 个 Cube CiM。最终版本将能够承载180万亿个参数的模型。Yoneda 表示:“我们将能够在你的手掌中创建一台能够以超低功耗处理 GPT-4 的人工智能计算机。”

配备18个“Cube CiM”的AI计算机可以容纳具有180万亿参数的模型。来源:Flowdia

内存在人工智能计算中起着关键作用

Flodia 总裁兼首席执行官 Yukio Okuyama 强调说:“Flodia 的目标是让记忆成为核心。” “它不仅仅是存储数据,还在AI计算中发挥主导作用。执行计算的GPU是主要角色,而内存则更多地是辅助角色,但我们希望改变这种状况。”

Yoneda 表示:“CiM 的概念由来已久,但并非可以轻易投入实际使用。这是因为 CiM 的性能和可靠性几乎完全取决于内存。非挥发性内存的物理特性和制造工艺技术是这一领域的钥匙,因此即使你拥有电路设计、软件和算法方面的专业知识,也绝不是可以立即实现的。” Floadia 首席技术官 (CTO) Yasuhiro Taniguchi 表示:“一些公司正尝试使用电阻式随机存取存储器 (ReRAM) 和磁阻式随机存取存储器 (MRAM) 来实现 CiM,但这些非易失性存储器在存储元件中不使用晶体管,因此无法将电流限制在纳安级。因此,他们永远无法模仿我们的 CiM 技术。”

Flowdia 于 2023 年完成了 10.5 亿日元的 D 轮融资。该公司计划于 2027 年 3 月进行首次公开募股 (IPO)。Taniguchi说:“我们希望在 2025 年专注于 CiM 演示,然后在 2027 年至 2028 年间认真开展业务。”

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。