碾压Blackwell!Groq成本低5倍、速度快一倍

随着人工智能算力持续扩容,算力基础设施服务商Nebius的一位专家接受采访时表示,虽然英伟达旗舰级 AIGPU的性能依旧稳居行业顶端,但随着行业成本核算指标发生转变,各类替代芯片的市场接受度正不断提升。目前市场对AI算力的需求依旧旺盛,算力服务商可实现满负荷运转,以此摊薄成本、最大化投资收益。

行业成本核算从每小时GPU算力转向百万令牌成本

该专家表示,当前AI基础设施行业的定价模式,取决于所使用的GPU型号,以及算力资源是预先预留还是按需调用。按需算力定价方面:英伟达H100 GPU时租价格为2.95美元,H200为3.50美元,最新的Blackwell B200 系列时租价格区间为4.90至6.50美元。

若选择预留算力,价格则会大幅下调。签署一至两年期合约、且算力采购量不少于1万块GPU的预留方案中,H100、H200单价分别降至1.50美元、2.20美元,B200最低单价为3.50美元。

2025年末,英伟达宣布与芯片初创企业Groq达成非独占授权合作。该合作是英伟达当时规模最大的一笔授权交易,合作内容涵盖这家初创企业的AI推理技术。Nebius专家指出,目前企业工作负载的整体需求中,推理业务占比已达90%至95%。核心原因在于,企业如今普遍采用预训练模型或API接口服务,不再自主研发底层模型程序。

专家表示,AI 基础设施市场的变化不止于从模型训练向推理应用倾斜,行业成本核算体系同步迭代,也进一步带动了英伟达GPU替代芯片的需求增长。

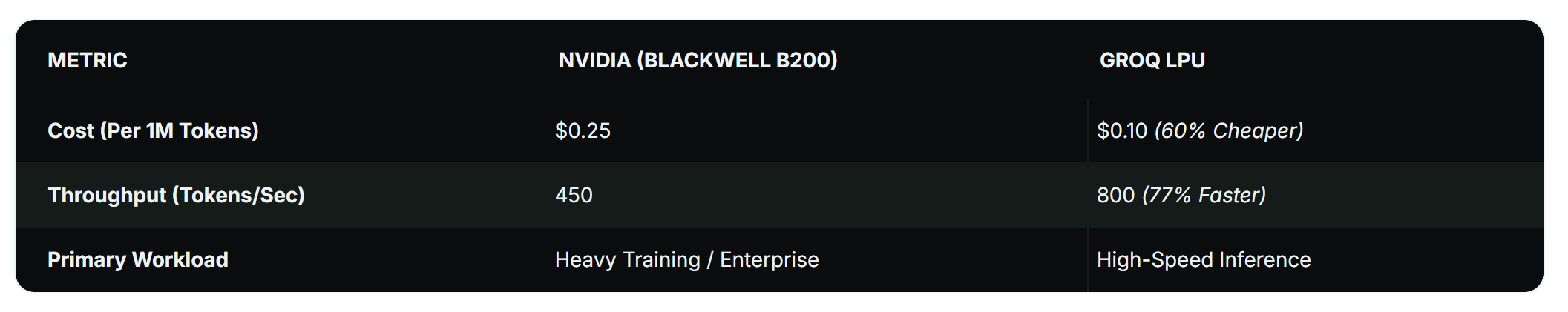

百万令牌计价对比:英伟达Blackwell芯片与Groq芯片成本拆解

全新的计价体系下,企业开始采用按令牌、按百万令牌的计费方式。数据显示,Groq芯片成本优势显著,每百万令牌计费仅0.05至0.10美元;反观英伟达 GPU,定价高出五倍,B100、B200、B300 系列每百万令牌成本为0.25美元。除此之外,Groq 芯片兼顾低成本与高性能。据Nebius专家介绍,其芯片每秒最高可输出800令牌,处理速度接近英伟达芯片(每秒 450 令牌)的两倍。

Groq LPU是专门用于大语言模型推理任务。此前该公司称,LPU芯片速度比H100快10倍,成本仅为其十分之一,以满足全球企业对“实时、低延迟”的AI推理服务的渴求。LPU的一大重要特点是采用了SRAM,这意味着其芯片的生产和部署速度比图形处理器更快,功耗也更低,而图形处理器通常能耗很高,且对于训练模型更为必要。Groq披露的数据显示,Groq芯片的片上内存带宽高达80TB/s以上,而目前顶尖GPU采用的HBM(高带宽内存)带宽仅约为8TB/s。

英伟达不久前推出了推理加速机架“Nvidia Groq 3 LPX”。这款机架配备了256个Groq 3 LPU芯片,拥有高达128GB的片上SRAM、315PFLOPS算力,以及640TB/s扩展带宽,并且可扩展至超过1000张LPU,致力于解决大语言模型推理中的延迟痛点。

作为对比,黄仁勋拿出Rubin GPU和Groq 3 LPU现场比较关键参数,Rubin GPU拥有3360亿颗晶体管、288GB HBM4显存及22TB/s带宽,在NVFP4精度下能达到50 PFLOPs的算力;Groq 3 LPU则走“极致片上速度”的极简路线,仅配备980亿颗晶体管与500MB SRAM(容量仅为Rubin的1/500),算力为1.2 PFLOPS,却凭借高达150TB/s的SRAM带宽实现了逆袭,其数据传输速度竟是Rubin的7倍之多。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。