CPU、GPU算力比例,将被重构

2026年3月,两项重磅消息接连发布:英伟达开始单独销售其 Vera CPU, Arm则推出了首款自研 CPU——Arm AGI CPU。一家GPU厂商与一家IP授权公司在同一个月双双进军CPU市场,这绝非巧合,反映出AI数据中心对CPU需求的结构性转变。

CPU在Agentic AI中的角色

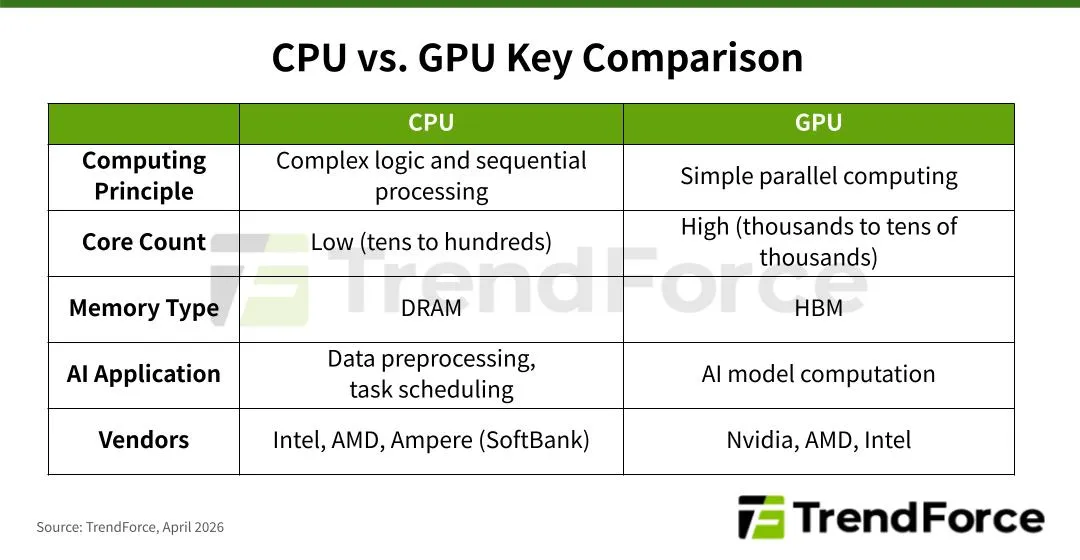

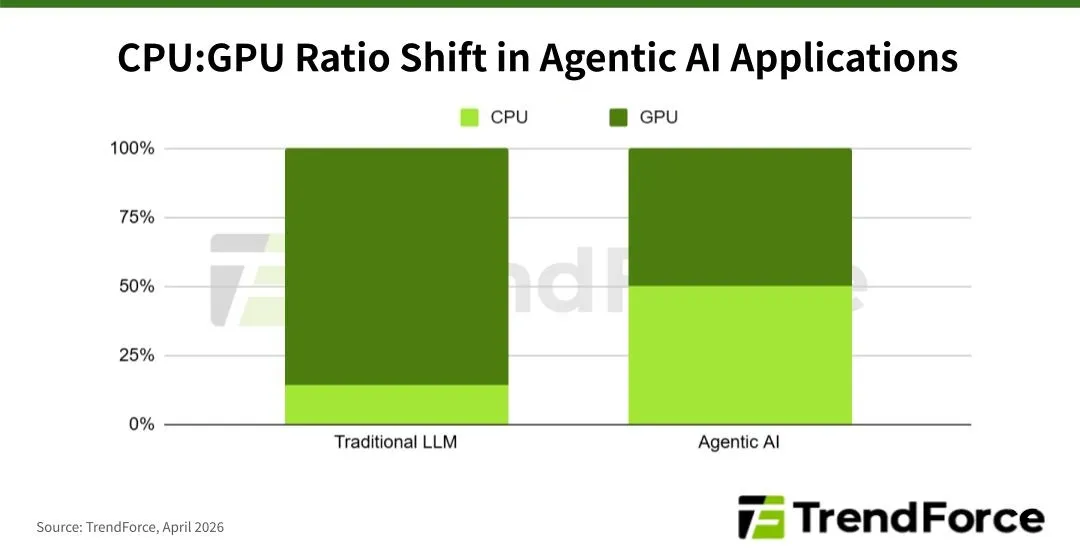

历史上,CPU一直是数据中心服务器的 “大脑”,负责处理复杂逻辑、串行计算,以及线性回归、决策树等传统机器学习任务。AI热潮改变了这一格局。如今AI模型需要海量并行矩阵乘法运算,而拥有大规模并行架构的GPU正是为此而生。CPU则退居次要地位,主要负责压缩、路由、将数据传输给GPU。因此,当前AI数据中心的CPU:GPU配比大约在1:4到1:8。

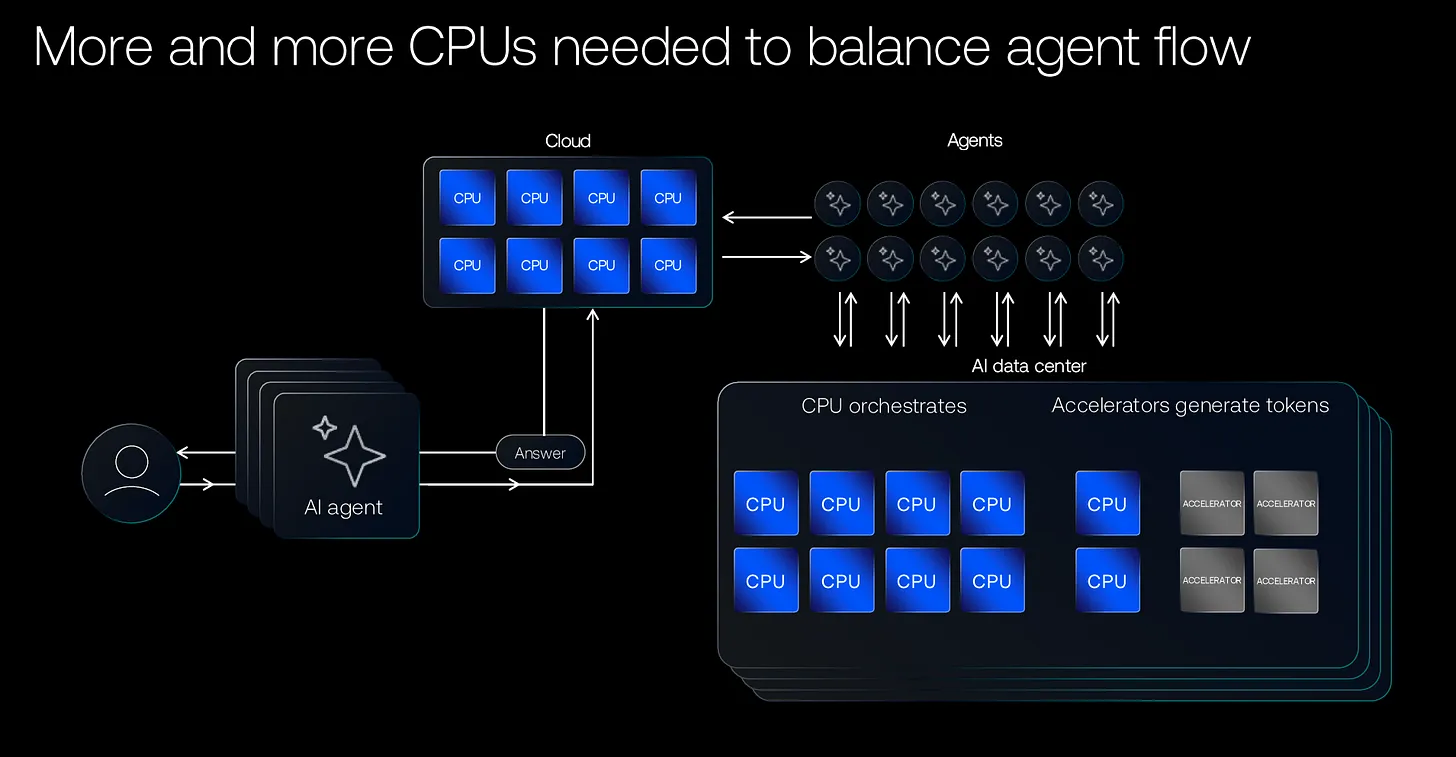

AI智能体的崛起正在打破这一平衡。与静态大语言模型不同,Agentic AI 旨在与环境动态交互:规划任务、调用工具、自主决策、代用户执行操作。管理这一切的调度协调层,包括子任务调度、工具调用路由、子智能体之间的数据传递、判断原始请求是否完成,完全落在CPU身上。这正是调度编排(Orchestration)成为CPU密集型任务的原因。

Agentic RL进一步提升了CPU需求。当AI智能体通过强化学习训练时,智能体的每一步动作都必须被评估,这一过程会给CPU带来额外负载。2025年11月的一篇论文《从CPU中心视角看Agentic AI》指出,CPU在工具处理任务中仍然至关重要,例如 Python 解释、网络爬虫、文本摘要、数据库查询等场景,这些在Agentic AI中极为普遍。

AI智能体在CPU层面主要面临三大瓶颈:

- 延迟:CPU上的工具处理可占总延迟的90.6%。

- 吞吐量:瓶颈可能来自CPU(核心数、缓存一致性、同步)或GPU(内存容量与带宽)。

- 功耗:在大批量规模下,CPU动态功耗可占整机动态功耗的 44%。

要解决这些问题,传统的CPU:GPU比例必须改变。Arm预计,传统AI数据中心每吉瓦功率需要约3000万颗CPU核心,而在AI智能体时代,这一需求将飙升至1.2亿核心,增长4倍。未来CPU:GPU比例预计将从1:4~1:8转向 1:1~1:2,显著提振CPU市场需求。

无论是AI负载还是数据中心通用服务器,CPU需求都出现激增。英特尔和AMD已在 2026年第一季度末对部分CPU产品线提价应对。

2026年CPU市场格局

这一需求转变正在重塑竞争格局。除传统服务器CPU厂商英特尔、AMD 外,一批新玩家纷纷入局:GPU厂商英伟达、IP授权方 Arm,以及 AWS、谷歌、微软等大型云服务商(CSP)。

传统 x86 厂商:英特尔、AMD

英特尔至强(Xeon)处理器曾长期占据数据中心CPU市场95%以上份额。其主导地位从2021年开始动摇:Intel 7 工艺良率问题导致Xeon Sapphire Rapids延期近两年,为采用台积电 N7 工艺、Zen3 架构的AMD EPYC Milan创造了机会。

2026年,英特尔计划推出两款重磅产品,均采用其最先进的Intel 18A 工艺,重申自研制造路线。Xeon 6+ (Clearwater Forest):Darkmont 架构,288 核 288 线程,TDP 约 450W,首次采用 Foveros Direct 混合键合。Xeon 7 (Diamond Rapids):Panther Cove X 架构,最高 256 核 256 线程,TDP 最高 650W。但由于 18A 工艺持续良率问题,两者大规模量产可能推迟至 2027年。

与此同时,AMD 继续与台积电合作。其EPYC Venice预计 2026年推出,采用Zen 6 架构、台积电 N2 工艺及先进封装(CoWoS L、SoIC),规格为 256 核 512 线程。AMD 预计 2026年将持续从英特尔手中夺取份额。

Arm 阵营新进入者:英伟达、Arm、Ampere、云厂商

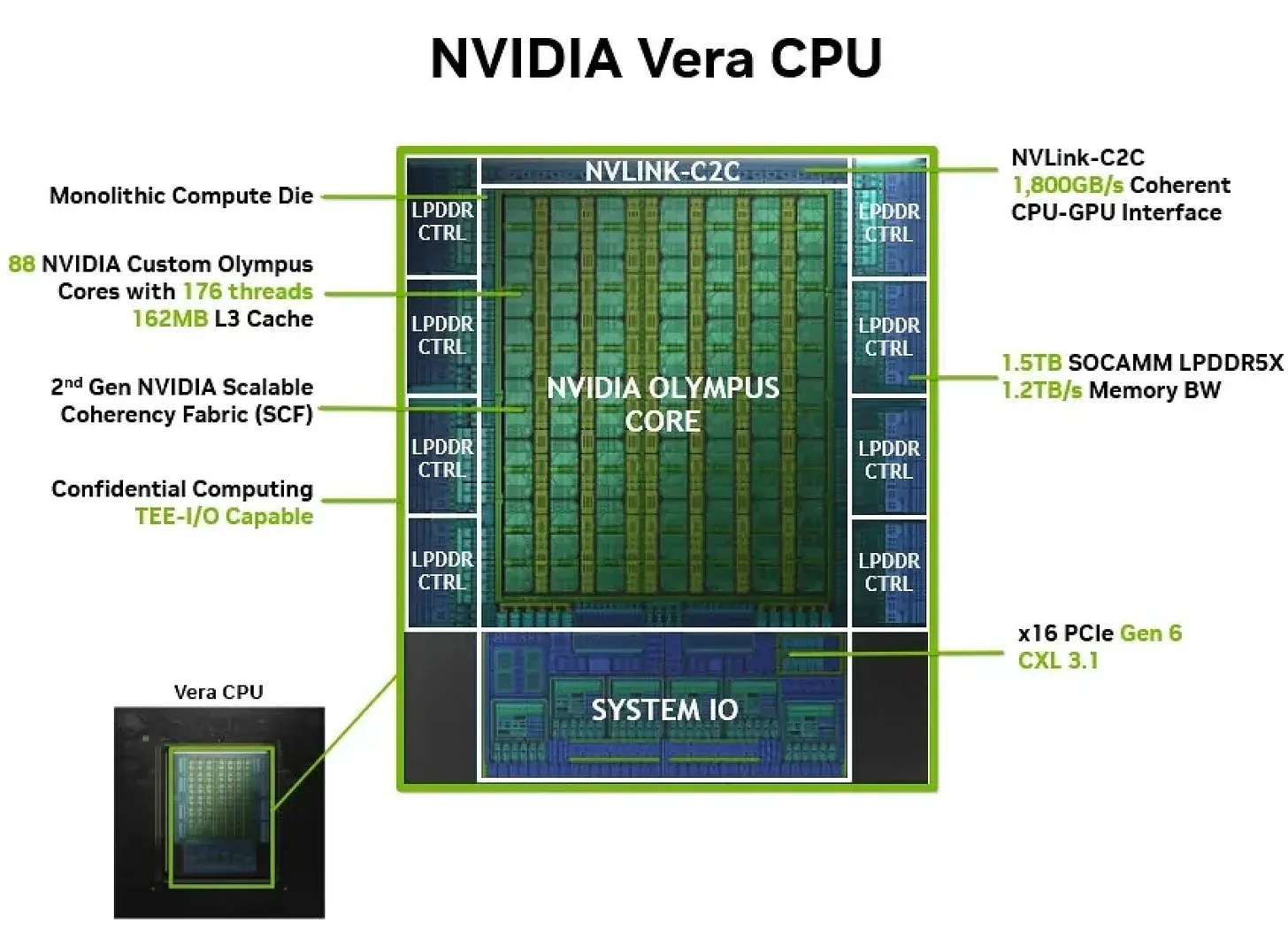

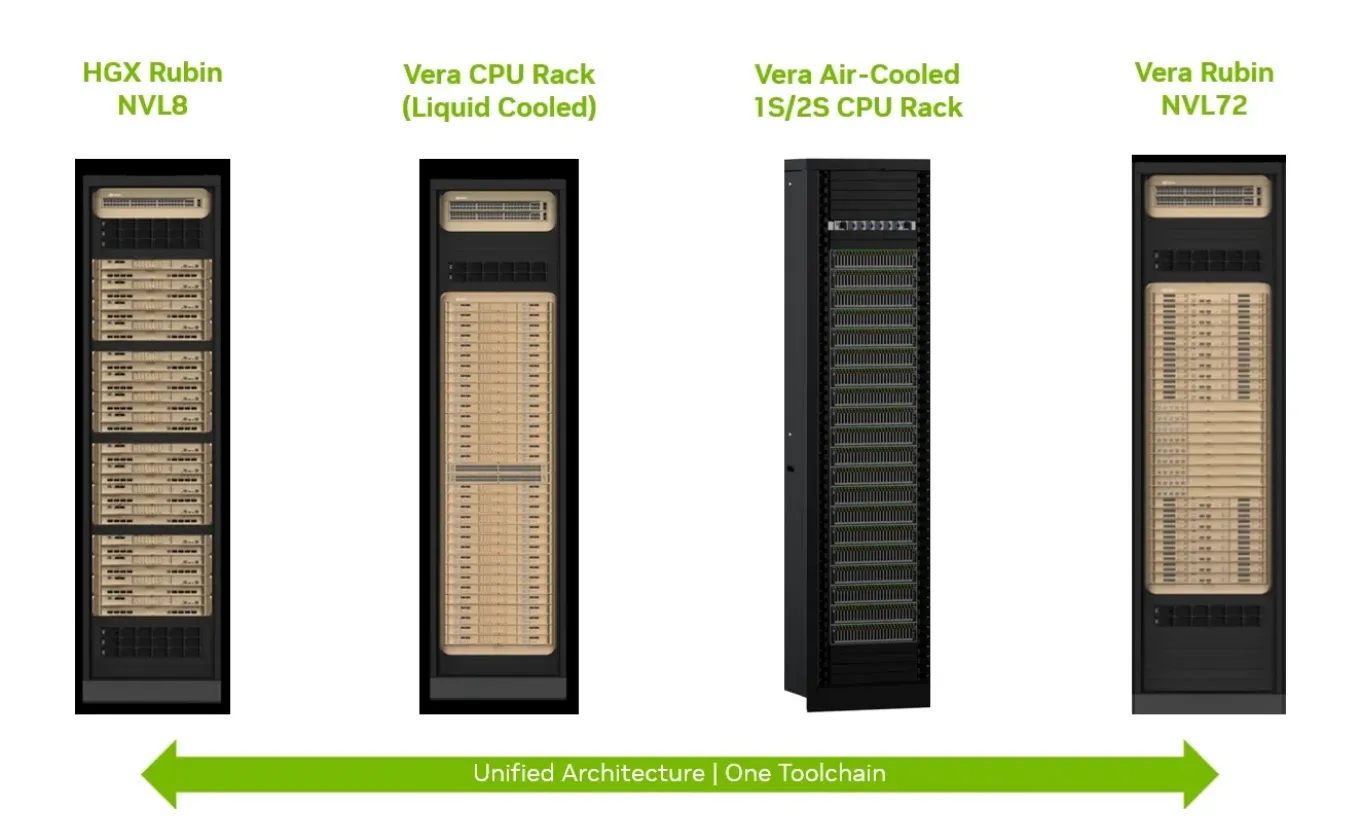

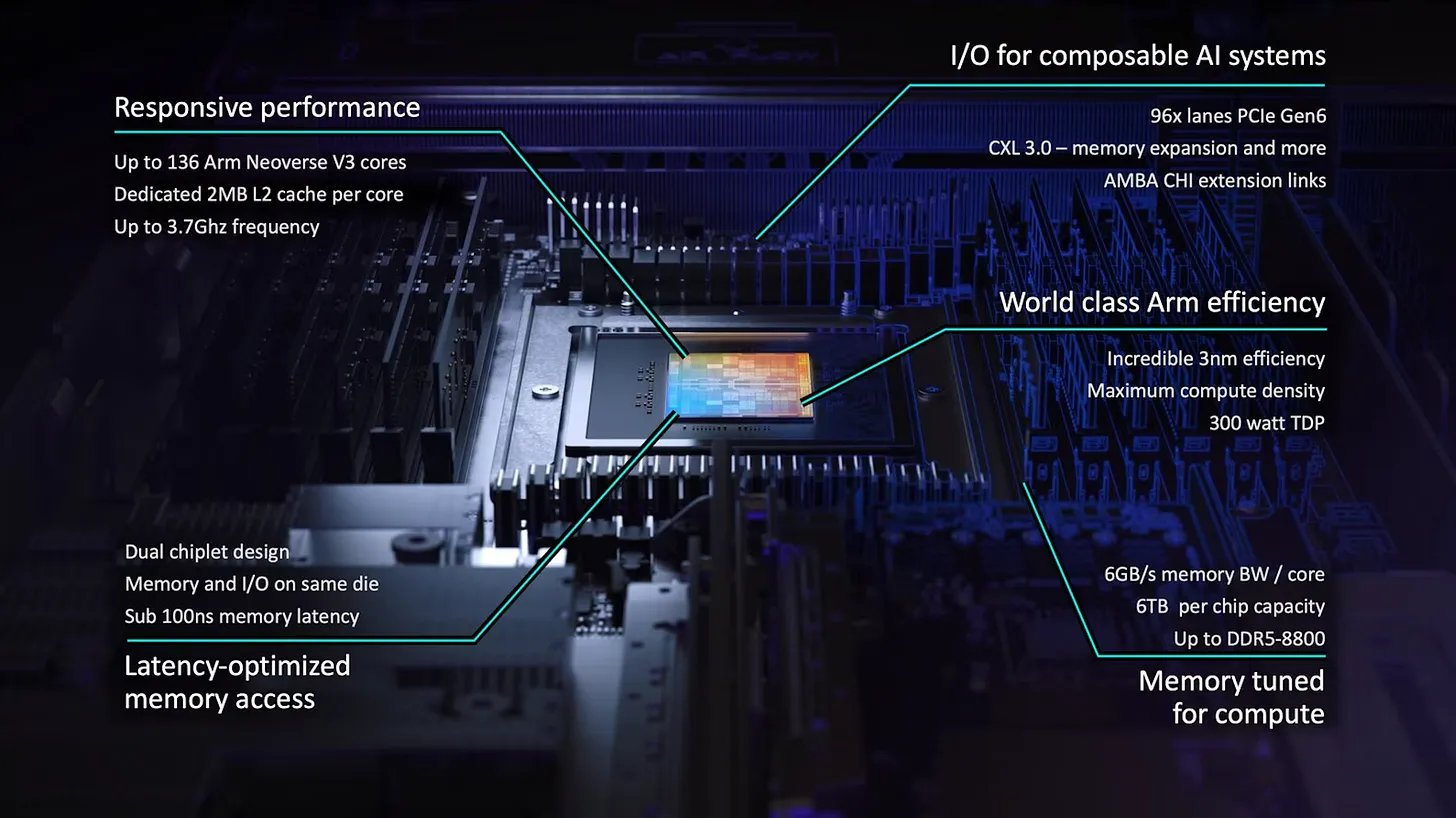

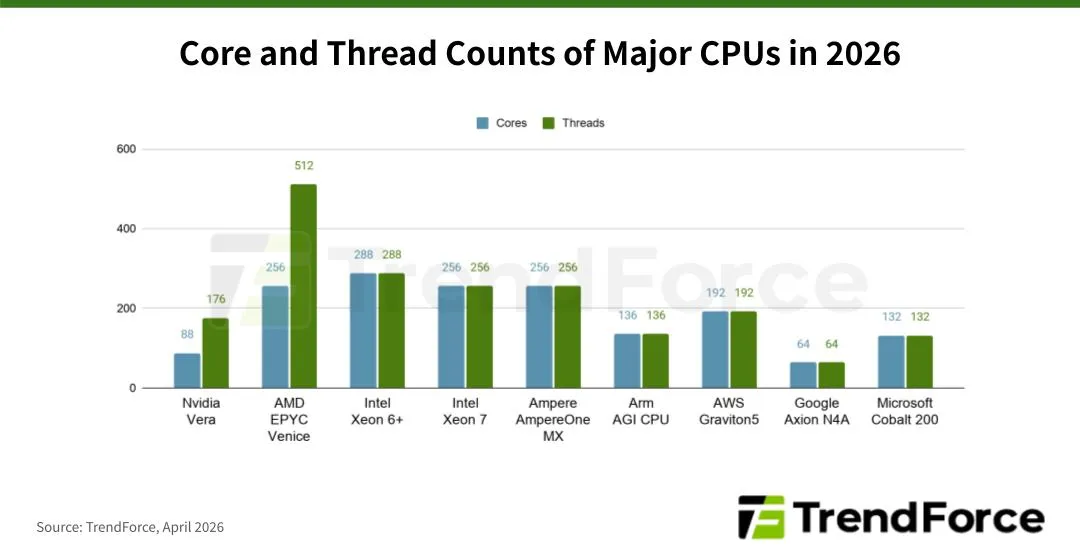

2026年3月,英伟达宣布单独销售Vera CPU,以满足客户对更灵活CPU:GPU配比的需求。早期合作伙伴包括阿里巴巴、字节跳动、Cloudflare、CoreWeave、Lambda、Oracle 等。Vera 采用英伟达自研Olympus 架构、台积电 N3 工艺、CoWoS R 封装,88 核 176 线程,支持空间多线程。尽管核心数低于英特尔、AMD 旗舰,但它提供1.8 TB/s NVLink C2C,可与英伟达GPU高速共享内存。

英伟达还推出基于MGX架构的Vera CPU机架。单机架包含32个1U计算托盘,每个托盘4颗Vera CPU节点,总计256颗CPU(22528 核 45056 线程、400TB 内存)。这些机架通过BlueField 4 DPU互联(集成 GraceCPU与 ConnectX 9),实现英伟达生态高度整合。

同样在2026年3月,Arm迈出前所未有的一步,推出Arm AGI CPU,结束35年纯授权模式。该芯片采用台积电 N3、Neoverse V3 架构,136 核 136 线程,首发合作伙伴包括 Meta、Cerebras、Cloudflare、OpenAI、SAP、SK Telecom 等。Arm也推出两款独立CPU机架:风冷版集成60颗 AGI CPU(8160 核 8160 线程、180TB 内存),液冷版支持336颗CPU(45696 核 45696 线程、1PB 内存)。

软银旗下的Ampere继192核 AmpereOne、AmpereOne M之后,预计2026年推出AmpereOne MX,提升至256核 256线程。

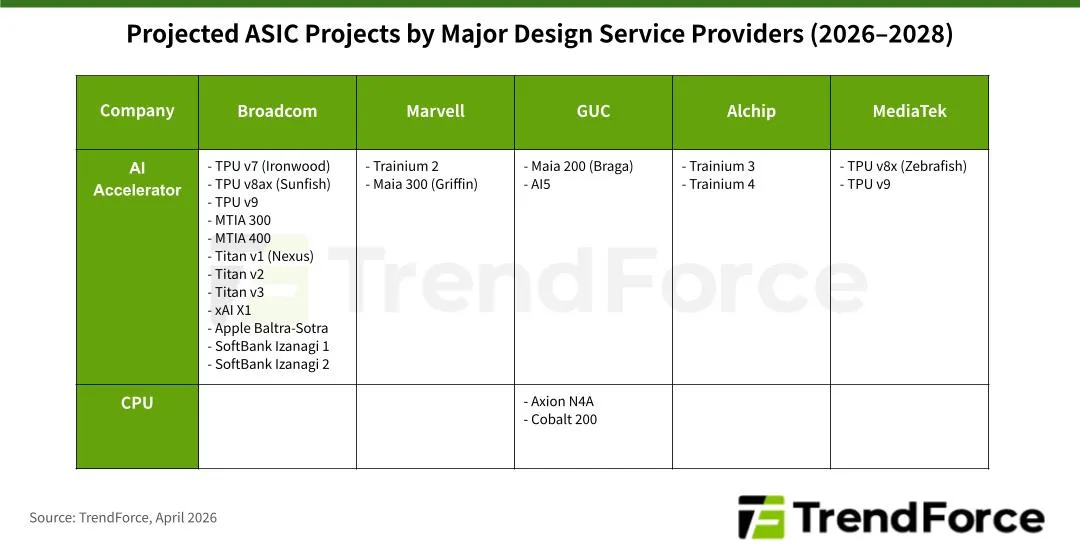

美国主流云厂商中,AWS布局最早,2016年推出首款自研 Graviton CPU(台积电 N16)。2025年12月发布Graviton5(N3,192 核 192 线程)。通过将定制CPU与 Trainium 3AIASIC 搭配,AWS 有效降低AI算力成本。

微软是第二家自研CPU的云厂商,2023年11月推出Cobalt 100与 Maia 100AI芯片(N5)。2025年11月推出下一代Cobalt 200(N3,132 核 132 线程)。

谷歌紧随其后,2024年4月推出首款定制CPUAxion C4A(N5)。2026年计划推出裸金属机型 Axion C4A.metal(96 核 96 线程)与下一代 Axion N4A(64 核 64 线程),战略目标是提供业界最优性价比。

下表总结2026年主流CPU核心/线程数。可见Xeon 6+ (Clearwater Forest)以 288 核最高,其后是AMDEPYC Venice、Xeon 7、AmpereOne MX 均为 256 核。但得益于超线程(SMT),AMD EPYC Venice 实现 256 核 512 线程,为当前最高线程数。

TrendForce认为,头部云厂商自研CPU的趋势将为IC后端设计服务商带来新增商机。目前AWS自研,谷歌与微软均将CPU后端设计外包给创意电子。

总结

Agentic AI推动CPU需求结构性反转。GPU长期主导AI大规模并行计算,CPU仅作为辅助负责内存调度。随着Agentic AI成熟,CPU重新具备战略地位,承担编排调度、工具调用、结果评估等核心工作。TrendForce 预计,CPU:GPU比例将从 1:4~1:8 转向 1:1~1:2。

英特尔自研工艺良率问题或加速AMD份额提升。英特尔2026年两款新品(18A 工艺)面临良率挑战,量产或延至 2027年。AMD EPYC Venice(台积电 N2、CoWoS-L、SoIC、512 线程)将持续抢占份额。

英伟达、Arm、云厂商入局,利好IC后端设计服务。除 x86 双雄外,英伟达、Arm、AWS、谷歌、微软纷纷进入服务器CPU市场。谷歌、微软已将CPU后端设计交给 GUC,AWS 保持自研,这一趋势将持续带来增量订单。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。