终检通过!微软 Maia200 AI 芯片就绪

作为芯片多元化战略的一部分,Maia200搭载海力士HBM3E内存,提振韩国半导体需求。

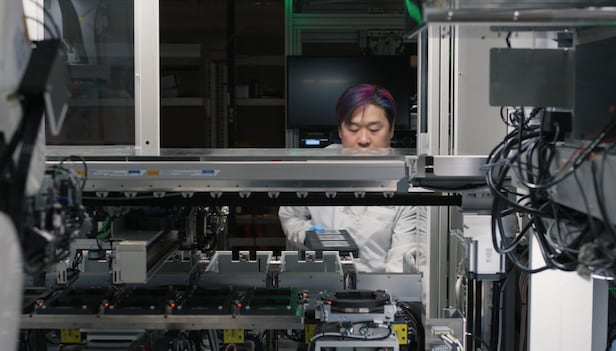

当地时间5日,在美国华盛顿州雷德蒙德市的微软“硅实验室”内,一台自动化机器人正按照预设流程,对微软最新一代自研AI芯片“Maia200”进行多维度质量检测。从芯片外观、封装完整性到基础电气性能,机器人以高精度标准完成各项检测工序,这也是Maia200正式进入规模化部署前的关键环节之一。此次公开检测场景,也是微软首次向外界直观展示其自研AI芯片的量产验证流程。

上月初,美国华盛顿州雷德蒙德微软园区的50号楼内,持续运转的服务器发出巨大噪音,即便佩戴专业隔音耳塞,仍能清晰感受到设备运行带来的震动与声响。整层空间的布局与正式运营的数据中心高度一致,内部整齐排列着数十组服务器机柜与配套散热系统,每个机柜中均搭载了48颗微软下一代人工智能芯片——Maia200。在这一接近真实运行的环境中,研发团队持续测试芯片在高负载状态下的性能表现,同时监控散热系统运行状态,确保核心温度稳定在约35摄氏度的安全区间。这一系列测试,是Maia200在正式部署至全球数据中心之前,必须完成的最终验收环节。

微软首次面向全球媒体公开Maia200从研发、流片到系统验证的完整流程。Maia200于今年早些时候正式对外发布,是微软继Maia100之后推出的第二代自研AI芯片,在推理速度、能效比和算力密度上均实现显著提升,推理效率达到当前行业领先水平。硬件配置方面,该芯片搭载了韩国SK海力士第五代高带宽内存HBM3E,凭借更高的传输速率和更低的功耗,为大模型推理与训练提供稳定支撑。

微软Azure营销副总裁杰西卡·霍克在现场采访中表示:“在人工智能全面普及的时代,支撑AI运行的底层硬件与系统架构,和AI模型算法本身拥有同等重要的地位。”她进一步指出,微软正在推进多项底层技术创新,一方面为全球数据中心配备最新一代自研芯片,另一方面通过优化散热架构、供电系统和硬件调度逻辑,持续降低数据中心整体功耗与水资源消耗,在提升算力效率的同时,推动云计算基础设施向更绿色、可持续的方向发展。

Maia 走进微软硅实验室

近年来,全球AI算力需求呈指数级增长,高端AI芯片供应紧张、成本居高不下成为云服务厂商共同面临的挑战。微软启动自研AI芯片项目,核心目标是减少对单一供应商高端芯片的过度依赖,同时通过芯片、系统与服务的深度协同,进一步优化Azure云平台的AI服务能力与成本结构。霍克对此解释称:“不同客户所需要执行的AI任务类型、预算规模和性能预期存在明显差异,单一芯片方案无法满足所有场景需求。”

基于这一判断,微软确立了多元化芯片供给策略:将自研Maia系列芯片与英伟达、AMD等厂商的AI芯片并行使用,根据任务负载智能调度硬件资源,为客户提供兼顾性能与成本的最优方案。在实际应用中,高复杂度、对算力要求极高的训练任务可采用英伟达高端GPU,而轻量化推理、边缘计算、日常AI服务等场景则由Maia200承担,以此实现算力资源的精细化分配,提升整体运行效率。

微软硅实验室承担着自研芯片从设计到落地的全链条验证工作,Maia200在正式部署前需要经过多层级、全流程的技术检测。第一步,芯片设计团队完成架构设计与逻辑验证后,实验室将对台积电提供的晶圆样本进行质量筛查,确保基础材料与制程工艺符合标准;第二步,由中国台湾台积电完成生产与封装的Maia200芯片,被置入高度模拟真实服务器运行环境的测试设备中,通过长时间压力测试,检验芯片的稳定性、兼容性与能效表现。

在完成单体芯片验证后,Maia200将被安装至标准服务器主板,进行整机功能测试;随后进入机柜级验证,多台服务器同时运行,模拟真实业务流量,检测供电、散热、网络传输等协同能力;最后进入数据中心系统级验证,在完整机房环境中进行大规模并行测试,确保芯片在极端负载下仍能稳定运行。微软内部人士强调:“部署在商用数据中心的AI芯片,需要承载来自全球数百万云服务用户的海量请求,任何细微的设计缺陷或质量问题,都可能引发大规模服务中断。因此,我们对每一项参数、每一个环节都执行最严格的检测标准。”

目前,通过全流程严苛验证的Maia200,已率先在微软位于美国爱荷华州得梅因的数据中心完成小规模部署并投入稳定运行。微软官方透露,下一步将按照既定计划,分阶段将Maia200扩展至美国亚特兰大、欧洲、亚洲等多个区域的数据中心,逐步提升自研芯片在整体算力架构中的占比。

Maia 芯片多元化战略:利好韩国半导体

在行业趋势层面,微软并非唯一推进芯片多元化的科技企业。当前,全球头部AI与云服务厂商纷纷加大自研芯片投入,构建“通用芯片+专用芯片”的混合架构,以此提升算力自主性、降低成本并优化能效。这一趋势背后,是英伟达高端GPU价格持续走高、供货周期拉长,以及通用型芯片在垂直场景中效率不足等现实问题。

谷歌长期布局自研张量处理器TPU,专注于AI训练与推理场景;亚马逊云服务AWS推出Trainium与Inferentia系列,为云端AI工作负载提供专用算力;Meta自研MTIA芯片,用于支撑旗下社交平台与AI研发需求;OpenAI此前正式宣布,将与博通合作研发自研AI芯片,进一步掌握算力主动权;特斯拉则围绕自动驾驶与人工智能业务,持续迭代自研AI芯片。即便是英伟达,也在GPU之外推出针对语言模型优化的LPU语言处理单元,通过多芯片架构提升能效与任务适配能力。

全球科技行业的芯片多元化战略,同样为韩国半导体产业带来重要发展机遇。随着自研AI芯片量产规模持续扩大,高带宽内存HBM、低功耗显存、主控芯片等核心元器件需求快速增长,直接利好三星电子与SK海力士两大存储芯片巨头。微软Maia200搭载的SK海力士HBM3E,凭借高速率、低功耗、高集成度等优势,已成为多家云厂商自研芯片的首选方案之一。与此同时,三星与SK海力士也在持续扩大对英伟达的HBM供应量,支撑全球AI芯片产能扩张。

除存储芯片外,韩国半导体的制造能力也在深度融入全球AI芯片产业链。三星电子的晶圆代工业务,正承接英伟达LPU、特斯拉自研芯片等多个高端项目,通过先进制程与封装技术,不断提升在AI芯片代工领域的市场份额。可以预见,在AI算力持续扩张、芯片多元化不断深化的背景下,韩国半导体产业有望凭借在存储与代工领域的优势,在全球AI硬件供应链中占据更重要的位置。而以微软Maia200为代表的自研芯片落地,也将进一步推动全球AI算力格局从集中化走向多元化、高效化与可持续化。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。