SK示警,芯片短缺将持续到2030年

韩国SK集团会长崔泰源表示,受人工智能驱动的需求持续超过供给影响,全球芯片晶圆短缺可能将持续至2030年。同时崔泰源透露,SK 海力士正考虑在美国发行美国存托凭证(ADR),以扩大全球投资者基础;同时,SK 海力士首席执行官可能会公布稳定 DRAM 芯片价格的相关计划,集团方面也在探索替代能源。

据 Counterpoint 数据显示,作为英伟达主要的高带宽内存(HBM)供应商,SK 海力士在HBM市场以57%的份额位居第一,同时以32%的份额占据全球 DRAM 市场第二大厂商位置。

崔泰源在解释晶圆短缺原因时表示,“人工智能对 HBM 的需求非常大,而生产 HBM需要消耗大量晶圆,因此我们需要至少四到五年时间来扩充晶圆产能。当前的短缺可能会持续到 2030 年,预计晶圆缺口将超过 20%。”

他表示,SK 海力士将设法制定稳定 DRAM 价格的策略。“我现在无法直接宣布,但我预计我们的 CEO 将公布一项稳定 DRAM 价格的新计划。”

当被问及是否会在美国扩大芯片制造产能(SK 海力士的众多客户均位于美国)时,崔泰源表示,建立海外工厂需要充足的电力、水资源、建设条件和工程人才,因此无法轻易按需落地,目前公司的重心仍在韩国本土生产。

关于潜在的美国 ADR 上市计划,崔泰源称,此举有助于将 SK 海力士的股东基础拓展至韩国以外,扩大对美国及国际投资者的覆盖面,强化其全球影响力。

崔泰源还提到,中东紧张局势推高了能源价格,带来诸多困难,这也推动集团寻求其他可替代的能源来源。

AI ASIC对HBM内存需求,四年猛增35倍

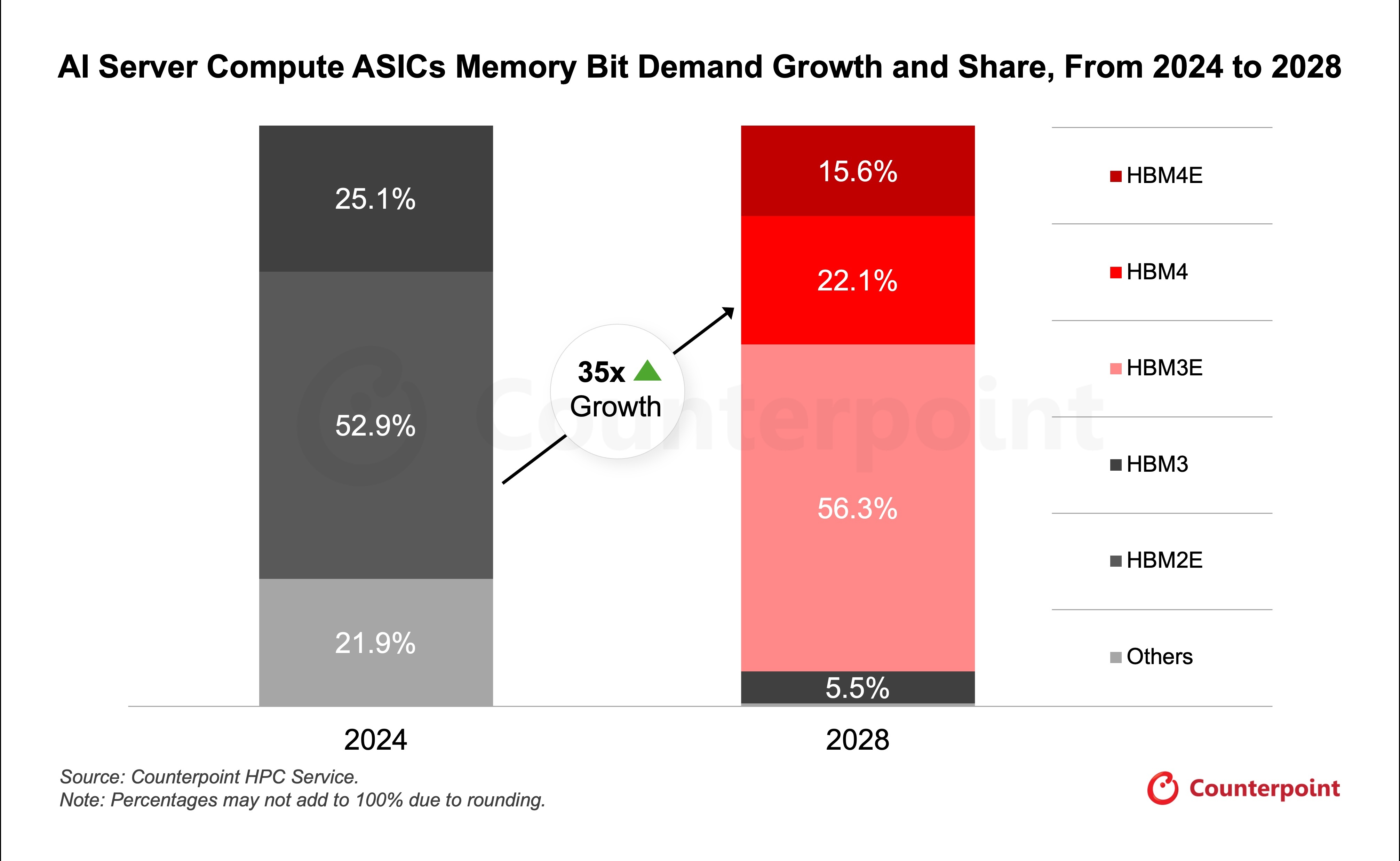

根据 Counterpoint Research 高性能计算(HPC)服务发布的最新《数据中心 AI 服务器计算 ASIC 出货量预测与追踪报告》,2024 年至 2028 年,面向 AI 服务器计算 ASIC 的全球高带宽内存(HBM)位宽需求预计将激增 35 倍。

基于此前对专用芯片加速的分析,这一爆发式增长主要得益于高密度内存架构在自研加速器中的广泛普及。核心增长驱动力包括:Google 为支撑 Gemini 生态系统对 TPU 基础设施进行大规模扩容、AWS 持续部署 Trainium 集群,以及 Meta MTIA 与 Microsoft Maia 的逐步上量。尽管超大规模云厂商仍在大力扩充自研芯片阵容,但行业整体趋势表明,HBM 已成为支撑下一代 AI 工作负载的关键技术与主要资本支出重心。

这一趋势的核心亮点在于,整个 AI 加速器整体潜在市场(TAM)正发生结构性转变:专用 ASIC 即将在全球 HBM 消耗量中占据快速扩张的份额。尤为关键的是,此次需求激增由单颗芯片内存密度的大幅提升所驱动。单芯片密度的指数级增长,正是为了响应下一代 AI 工作负载不断攀升的需求。随着超大规模云厂商快速迈向万亿参数模型、多模型架构与复杂的混合专家(MoE)设计,需要极高的内存密度将更大规模数据集靠近计算核心,从而最大化数据吞吐量、降低高阶推理任务延迟,并避免内存瓶颈拖累整体系统性能。

这一发展趋势意味着,AI 服务器计算 ASIC 将在整个 HBM 市场中占据越来越高的比重,从根本上改变内存需求过度依赖通用 GPU 的单一格局。与此同时,ASIC 底层内存技术正迎来明确的代际切换。HBM3E 预计将实现绝对主导,到 2028 年将占据 ASIC 整体 HBM 位宽需求的约 56%,这是因为云服务厂商优先选择最高带宽能力与成熟的供应链体系。

从厂商市占率来看,全球 HBM 格局仍将高度集中,SK 海力士与三星在可预见的未来将保持主导地位。不过,市场份额的内部结构正在快速变化。Counterpoint预计三星将稳步扩大市场份额,并加速缩小与头部厂商的差距。在成功克服此前的生产瓶颈后,三星良率企稳、产品性能优化,使其有能力在新一轮 AI 基础设施部署中强势夺回份额。由于这并非零和博弈,Counterpoint也在密切关注美光的设计中标与产能情况,看其能否在面向 AI 服务器专用加速器的 HBM 市场实现强势突破。

本文转自媒体报道或网络平台,系作者个人立场或观点。我方转载仅为分享,不代表我方赞成或认同。若来源标注错误或侵犯了您的合法权益,请及时联系客服,我们作为中立的平台服务者将及时更正、删除或依法处理。